Губко М.В. Лекции по принятию решений в условиях нечеткой информации

Подождите немного. Документ загружается.

20

Ниже мы будем пользоваться только максиминным произведением нечетких отно-

шений, обозначая произведение отношений

1

~

R и

2

~

R через

21

~

~

RR o .

В теории принятия решений нечеткие бинарные отношения используются в основ-

ном для описания предпочтений ЛПР. Понятно, что не любое бинарное отношение соот-

ветствует содержательной интерпретации отношения предпочтения «не хуже чем». Ска-

жем, от рационального отношения предпочтения

R

~

стоит ожидать как минимум того, что-

бы любой исход был достоверно не хуже себя самого, то есть, чтобы 1),(

~

=

xx

R

m

для всех

Xx

Î

. Ниже определяются основные свойства нечетких бинарных отношений и при-

водятся соответствующие примеры.

Определение 15. Нечеткое бинарное отношение

R

~

называется рефлексивным, если

1),(

~

=

xx

R

m

для всех

Xx

Î

. Если 0),(

~

=

xx

R

m

для всех

Xx

Î

, то отношение

R

~

называется

антирефлексивным.

Понятно, что отношение «не хуже» обычно рефлексивно, а отношение «строго луч-

ше» – антирефлексивно.

Определение 16. Нечеткое бинарное отношение

R

~

симметрично, если для любых

Xyx

Î

, ),(),(

~~

xyyx

RR

m

m

=

и антисимметрично, если из того, что 0),(

~

>

yx

R

m

следует, что

0),(

~

=

xy

R

m

.

Примером симметричного нечеткого отношения является нечеткая эквивалент-

ность – отношение безразличия альтернатив.

Определение 17. Нечеткое бинарное отношение называется транзитивным, если

RRR

~

~

~

Ío .

Транзитивность является одним из основных свойств рационального отношения

предпочтения. Она означает, что если исход x не хуже исхода z с достоверностью ),(

~

zx

R

m

,

а исход z не хуже исхода y с достоверностью ),(

~

yz

R

m

, то достоверность того, что x не хуже

y не может быть меньше )],();,(min[

~~

yzzx

RR

m

m

.

3.2. Нечеткие отношения предпочтения

В этом разделе мы более подробно остановимся на свойствах нечетких отношений

предпочтения. Как уже отмечалось, отношение предпочтения R выполнено для пары

Xyx

Î

, , если альтернатива x не хуже для ЛПР, чем альтернатива y. Однако в реальности

ЛПР или эксперты могут не иметь четкого представления о предпочтениях между всеми

или некоторыми из альтернатив. В этом случае можно говорить о нечетком отношении

предпочтения

R

~

, функция принадлежности которого для каждой пары Xyx

Î

, определя-

ет достоверность ]1;0[),(

~

Î

yx

R

m

того, что альтернатива x не хуже альтернативы y.

От нечеткого отношения предпочтения логично требовать рефлексивности, чтобы

любая альтернатива была достоверно не хуже самой себя. Итак,

Определение 18. Нечетким отношением предпочтения (НОП) на множестве X на-

зывается произвольное рефлексивное нечеткое бинарное отношение на X.

На основе отношения

R

~

«не хуже» можно определить отношение строгого пред-

почтения

s

R

~

(отношение «строго лучше») и отношение

I

R

~

безразличия между альтерна-

тивами.

В четком случае альтернатива

Xx

Î

строго предпочитается альтернативе Xy

Î

,

если x «не хуже» y (то есть Ryx

Î

),( ) но обратное неверно, то есть Rxy

Ï

),( (иначе говоря,

1

),(

-

Ï Ryx ). Таким образом,

1

\

-

= RRR

s

. Аналогично и в нечетком случае

Определение 19. Нечетким отношением строгого предпочтения, соответствую-

щим НОП

R

~

, называется нечеткое бинарное отношение

1

~

\

~

~

-

= RRR

s

.

По определениям обратного бинарного отношения и разности нечетких множеств

имеем, что функция принадлежности отношения строгого предпочтения записывается так:

21

(7) ]0);,(),(max[),(

~~

~

xyyxyx

RR

R

s

m

m

m

-

=

.

Значение функции принадлежности определяет степень достоверности строго

предпочтения между альтернативами. Заметим, что, поскольку НОП

R

~

рефлексивно, от-

ношение строго предпочтения является антирефлексивным и антисимметричным.

Если ),(

~

yx

s

R

m

равно некоторому числу ]1;0[

Î

l

, то мы будем говорить, что альтер-

натива x доминирует альтернативу y с достоверностью

l

.

Альтернатива x в четком случае безразлична альтернативе y, если либо одновре-

менно xRy и yRx (то есть как х не хуже y, так и у не хуже x), либо одновременно Ryx

Ï

),( ,

Rxy

Ï

),( (нет информации, чтобы сравнить эти альтернативы) и, тем самым,

)())(\)((

11 --

´= RRRRXXR

I

IUU . Также и в нечетком случае

Определение 20. Нечетким отношением безразличия, соответствующим НОП

R

~

,

называется нечеткое бинарное отношение )

~

~

())

~

~

(\)((

~

11 --

´= RRRRXXR

I

IUU .

Формула для функции принадлежности нечеткого отношения безразличия более

сложная, чем для строгого предпочтения – она выглядит следующим образом:

)]],();,(min[)];,(1);,(1max[min[),(

~~~~

~

xyyxxyyxyx

RRRR

R

I

m

m

m

m

m

-

-

=

.

Из этой формулы, а также из рефлексивности НОП

R

~

следует, что отношение без-

различия рефлексивно и симметрично.

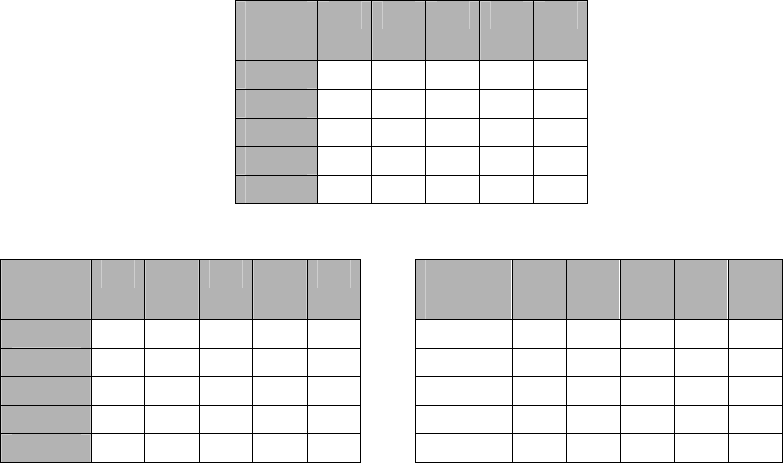

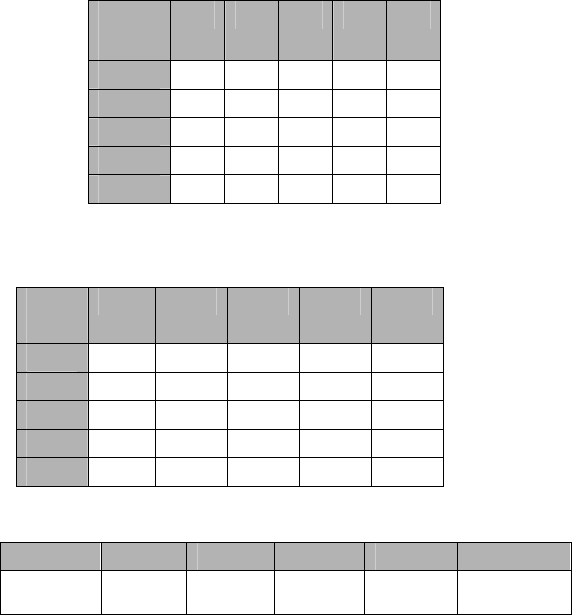

Пример 16. Пусть предпочтения студента на множестве оценок экзамена задаются

следующим НОП:

R

~

y

x

1 2 3 4 5

1 1 0 0 0 0

2 0 1 0.1 0 0

3 1 1 1 0.2 0

4 1 1 0.8 1 0.3

5 1 1 1 0.7 1

Тогда отношения строгого предпочтения и безразличия принимают вид:

s

R

~

y

x

1 2 3 4 5

I

R

~

y

x

1 2 3 4 5

1 0 0 0 0 0 1 1 1 0 0 0

2 0 0 0 0 0 2 1 1 0.1 0 0

3 1 0.9 0 0 0 3 0 0.1 1 0.2 0

4 1 1 0.6 0 0 4 0 0 0.2 1 0.3

5 1 1 1 0.4 0 5 0 0 0 0.3 1

Мы видим, что оценки 1 и 2 студенту безразличны просто из-за того, что в отноше-

нии предпочтения нет информации об их взаимной предпочтительности (возможно, по

причине отсутствия опыта получения этих оценок). ·

Важным свойством отношения предпочтения является его линейность (или полно-

та). В четком случае бинарное отношение R называется линейным, если для любой пары

альтернатив Xyx

Î

, либо xRy , либо yRx . Это гарантирует, что у ЛПР достаточно инфор-

мации для того, чтобы сравнивать любые альтернативы. В терминах функции принад-

лежности свойство линейности выглядит так: для всех Xyx

Î

, 1)],(),,(max[

=

xyyx

RR

m

m

.

Однако при обобщении свойства линейности на нечеткие отношения в такой фор-

мулировке оно оказывается слишком сильным. Поэтому мы дадим несколько определений

линейности НОП:

22

Определение 21. НОП

R

~

на X называется сильно линейным, если для всех Xyx

Î

,

1)],();,(max[

~~

=

xyyx

RR

m

m

.

Определение 22. НОП

R

~

на X называется

l

-линейным, если для всех Xyx

Î

,

l

m

m

>

)],();,(max[

~~

xyyx

RR

. 0-линейное отношение также будем называть слабо линейным.

Таким образом, в

l

-линейном отношении для любой пары Xyx

Î

, либо x не хуже y

с достоверностью, большей

l

, либо наоборот.

Упражнение 4. Докажите, что для сильно линейного НОП

R

~

),(1),(

~

~

xyyx

s

R

R

m

m

-

=

.

3.3. Множество недоминируемых альтернатив

Итак, НОП позволяет сравнивать взаимную предпочтительность альтернатив. Если

в задаче принятия решения известно НОП

R

~

ЛПР на множестве альтернатив, то логично

задаться вопросом о том, какая же из альтернатив является наилучшей с точки зрения

ЛПР. Такие альтернативы называют недоминируемыми.

Зафиксируем некоторую альтернативу Xx

Î

0

и рассмотрим нечеткое множество с

функцией принадлежности Xyx

s

R

Í

),(

0

~

m

. Это нечеткое множество альтернатив, которые

доминируются альтернативой

0

x . Тогда его дополнение с функцией принадлежности

),(1

0

~

yx

s

R

m

-

будет множеством альтернатив, которые не доминируются альтернативой

0

x ,

являясь, в некотором смысле «лучше ее». Мы же интересуемся альтернативами, которые

были бы одновременно лучше любой другой альтернативы из множества X. Как мы ви-

дели ранее, если задано семейство нечетких множеств, каждое из которых обладает неко-

торым свойством, то для того, чтобы найти нечеткое множество, которое одновременно

обладало бы всеми свойствами, надо взять пересечение всех множеств семейства.

Таким образом, по формуле пересечения нечетких множеств мы можем определить

множество недоминируемых альтернатив с функцией принадлежности

(8) ),(sup1)],(1[inf)(

~~

~

yxyxy

ss

R

Xx

R

Xx

НД

R

mmm

Î

Î

-=-= .

Пример 17. Рассмотрим отношение предпочтения студента из предыдущего при-

мера. По формуле (8) вычислим множество недоминируемых альтернатив:

Y 1 2 3 4 5

)(

~

y

НД

R

m

0 0 0 0.6 1

Альтернатива 5 недоминируема с достоверностью 1. Такие альтернативы мы будем

называть четко недоминируемыми. Однако и альтернатива 4 недоминируема, хотя и с

достоверностью меньше единицы. ·

Доказательство следующих простых утверждений мы оставляем в качестве упраж-

нений.

Упражнение 5. Докажите, что )],(),([sup1)(

~~~

xyyxy

RR

Xx

НД

R

mmm

--=

Î

.

Упражнение 6. Докажите, что для сильно линейного НОП ),(inf)(

~~

xyy

R

Xx

НД

R

mm

Î

= .

Свойства нечеткого множества недоминируемых альтернатив определяются свой-

ствами НОП. В частности, множество недоминируемых альтернатив может оказаться пус-

тым. Приведем соответствующий пример.

Пример 18. Рассмотрим четкое отношение предпочтения вида.

R

~

y

x

1 2 3

1 1 0 1

2 1 1 0

3 0 1 1

23

Легко проверить, что множество недоминируемых альтернатив для данного отно-

шения пусто. Также легко проверить, что это отношение предпочтения является нетранзи-

тивным. Таким образом, транзитивность отношения предпочтения является важным усло-

вием существования недоминируемых альтернатив. ·

Степень принадлежности альтернативы множеству недоминируемых альтернатив

определяет, в какой мере данная альтернатива не доминируется никакой другой. Поэтому

в задаче принятия решения на основе НОП логичным представляется выбор альтернатив,

степень принадлежности которых множеству недоминируемых альтернатив максимальна.

Определение 23. Множеством максимально недоминируемых альтернатив назы-

вается четкое множество )}(sup)(:{:

~~~

yxXxX

НД

R

Xy

НД

R

НД

R

mm

Î

=Î= альтернатив, степень недоми-

нируемости которых максимальна. Если 1)(sup

~

=

Î

y

НД

R

Xy

m

, то соответствующее множество

НД

R

X

~

называется множеством четко недоминируемых альтернатив, или множеством

Орловского, и обозначается

ЧНД

R

X

~

.

Если альтернатива

ЧНД

R

Xx

~

Î , то она достоверно не доминируется никакой другой

альтернативой и, очевидно, выбор такой альтернативы наиболее предпочтителен. В случае

непустого множества четко недоминируемых альтернатив мы получаем, по сути, четкое

решение нечеткой задачи.

Интересными, поэтому, являются условия, при которых можно гарантировать су-

ществование четко недоминируемых альтернатив. На эту тему существует много различ-

ных результатов. Мы приведем лишь один из наиболее простых, подчеркивающих важ-

ность свойства транзитивности НОП.

Теорема 2 [2]. В конечном множестве альтернатив X с заданным на нем транзитив-

ным НОП имеется по крайней мере одна четко недоминируемая альтернатива.

Множество четко недоминируемых альтернатив для сильно линейного НОП обла-

дает еще и следующими важными свойствами.

Теорема 3 [2]. Если отношение

R

~

на множестве альтернатив сильно линейно, то

для любой четко недоминируемой альтернативы

ЧНД

R

Xx

~

0

Î и любой другой альтернативы

Xx

Î

1),(

0

~

=

xx

R

m

.

Теорема 4 [2]. Если отношение

R

~

на множестве альтернатив сильно линейно и

транзитивно и

ЧНД

R

Xx

~

0

Ï , то для любой альтернативы

Xx

Î

0),(

0

~

>

xx

s

R

m

.

Доказательство теорем 2-4 несложно и предлагается в качестве упражнения.

3.4. Общая задача нечеткого математического программирования

В предыдущем разделе мы не отделяли множество альтернатив (действий ЛПР) от

множества результатов (состояний системы), считая, что ЛПР может непосредственно вы-

брать тот или иной результат. Мы выяснили, что в этом случае рациональным выбором

ЛПР являются альтернативы (результаты, состояния системы), максимально недомини-

руемые по НОП.

Однако в большинстве случаев множество действий X и множество результатов

действий Y различны, и действие ЛПР приводит к реакции системы, которая известна

лишь нечетко. Для описания подобных ситуаций на прошлой лекции мы ввели нечеткое

отображение YX

®

:

~

j

, которое каждому действию

Xx

Î

ставило в соответствие его об-

раз )(

~

x

j

– нечеткую реакцию системы на выбор данного действия.

Таким образом, выбирая то или иное действие

Xx

Î

, ЛПР, по сути, выбирает то

или иное нечеткое множество результатов (исходов) )(

~

x

j

. Если у ЛПР есть НОП на мно-

жестве нечетких подмножеств множества Y, которое позволяет ему сравнивать по пред-

почтительности пары нечетких подмножеств, то задача сводится к рассмотренной выше:

24

среди нечетких множеств )(

~

x

j

найти максимально недоминируемое по НОП множество

)(

~

*

x

j

, которое получается в результате выбора некоторого действия Xx Î

*

.

Тем не менее, в задачах принятия решений обычно считается, что ЛПР имеет НОП

R

~

на множестве результатов Y. С помощью этого отношения он умеет сравнивать лишь

отдельные результаты из множества Y, а не нечеткие подмножества результатов. Чтобы

выбрать рациональное действие, ЛПР должен научиться сравнивать между собой не

только исходы, но и действия (нечеткие исходы). Следовательно, мы должны каким либо

способом обобщить заданное на множестве исходов НОП на класс нечетких подмножеств

множества исходов.

На предыдущей лекции мы уже делали нечто похожее, когда расширяли на класс

всех нечетких множеств область определения нечеткого отображения.

Мы говорили, что если задано нечеткое отображение YX

®

:

~

j

, которое каждому

элементу

Xx

Î

ставит в соответствие нечеткое множество Yx

Í

)(

~

j

, то образом произ-

вольного нечеткого множества XA Í

~

при этом отображении будет нечеткое подмноже-

ство )

~

(

~

A

j

множества Y с функцией принадлежности )],();(min[sup)( ~

~

)

~

(

~

yxxy

A

Xx

A

j

j

m

m

m

Î

=

.

Но ведь нечеткое бинарное отношение YYR ´Í

~

можно рассматривать и как не-

четкое отображение YYR ®:

~

(формально их определения совпадают). Так, для произ-

вольного результата Yy

Î

0

нечеткое множество с функцией принадлежности

),()(

0

~

)(

~

0

yyy

RyR

m

m

=

можно рассматривать как образ этого результата при нечетком ото-

бражении

R

~

. А образом нечеткого множества YA Í

~

будет нечеткое множество )

~

(

~

AR с

функцией принадлежности )],'();'(min[sup:)(

~~

'

)

~

(

~

yyyy

RA

Yy

AR

m

m

m

Î

=

. С другой стороны, для

фиксированного результата Yy

Î

1

значение )(

1

)

~

(

~

y

AR

m

можно рассматривать как степень

выполнения бинарного отношения

R

~

для пары, состоящей из нечеткого множества

A

~

и

отдельного исхода

1

y .

Таким образом, мы определили «нечеткое бинарное отношение»

1

~

R с функцией

принадлежности )],'();'(min[sup),

~

(

~~

'

~

1

yyyyA

R

A

Yy

R

mmm

Î

= , которое позволяет сравнить по пред-

почтительности любое нечеткое множество YA Í

~

с произвольной альтернативой Yy

Î

.

Мы можем продолжить процесс обобщения – заменить альтернативу Yy

Î

нечет-

ким множеством

B

~

и по формуле

(9) )]]'','();'(min[sup);''(min[sup)]'',

~

();''(min[sup)

~

,

~

(

~~

'

~

''

~~

''

~

12

yyyyyAyBA

R

A

Yy

B

Yy

RB

Yy

R

mmmmmm

ÎÎÎ

==

найти степень достоверности того, что нечеткое множество

A

~

«не хуже» нечеткого мно-

жества

B

~

по НОП

R

~

. Таким образом, мы получили искомое обобщение заданного на

множестве Y НОП

R

~

на класс всех нечетких множеств. Обозначим обобщенное (или, как

еще говорят, индуцированное) НОП через

R

~

~

.

Легко показать, что формулу (9) для функции принадлежности индуцированного

НОП

R

~

~

можно преобразовать к виду

(10) )]''();'','();'(min[sup)

~

,

~

(

~~~

'','

~

~

yyyyBA

BR

A

Yyy

R

mmmm

Î

= .

Подставляя в эту формулу вместо произвольных нечетких множеств образы дейст-

вий ЛПР при нечетком отображении

j

~

, получим следующее выражение для индуциро-

ванного НОП на множестве действий ЛПР:

(11) )]'',''();'','();','(min[sup)'','( ~

~

~

'','

~

~

yxyyyxxx

R

Yyy

R

jj

m

m

m

m

Î

=

.

Посмотрим, как «работает» индуцированное нечеткое бинарное отношение.

25

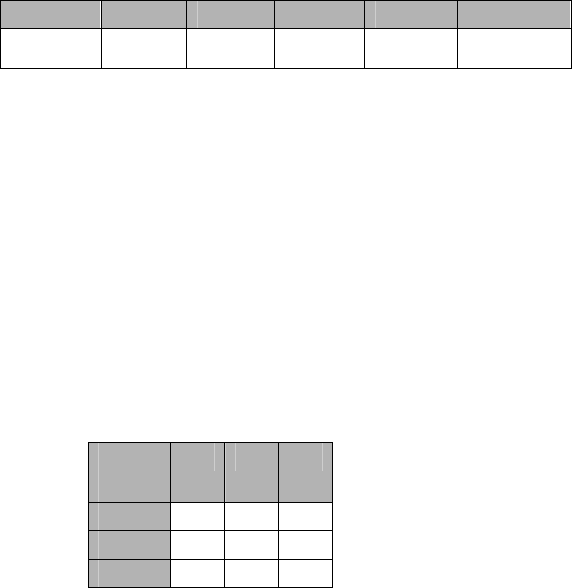

Пример 19. Пусть на числовой оси задано четкое бинарное отношение R «не

меньше». Возьмем пару нечетких множеств

A

~

и

B

~

с функциями принадлежности

])1(1;0max[)(

2

~

--= xx

A

m

, ])2(21;0max[)(

2

~

--= xx

B

m

, изображенными на рисунке 13, и вы-

ясним, в какой степени

A

~

не меньше, чем

B

~

.

Для заданного на числовой оси четкого бинарного отношения «не меньше» форму-

ла (10) приобретает более простой вид:

(12) )]''();'(min[sup)

~

,

~

(

~~

'''

~

~

xxBA

B

A

xx

R

mmm

³

= .

При этом понятно, что максимум в правой части достигается при 2''' == xx и ра-

вен )12(2 - , то есть

A

~

не меньше, чем

B

~

со степенью достоверности )12(2 - .

Рисунок 13. Сравнение нечетких множеств по индуцированному НОП

Проверим, в какой степени выполнено обратное отношение, то есть, в какой степе-

ни

B

~

не меньше, чем

A

~

. Из формулы (12) мы видим, что если точка пика функции при-

надлежности множества

B

~

лежит правее точки пика функции принадлежности множества

A

~

, то степень выполнения индуцированного бинарного отношения равна единице. ·

Интересно, что многие свойства исходного нечеткого бинарного отношения сохра-

няются и в индуцированном бинарном отношении, но не для всех нечетких множеств, а

только для нормальных (напомним, что нечеткое множество

A

~

называется нормальным

если

1)(sup

~

=

Î

x

A

Xx

m

). В частности, справедливы следующие результаты:

Теорема 5 [2]. Если НОП

R

~

на множестве Y рефлексивно, то и индуцированное

НОП

R

~

~

рефлексивно на множестве всех нормальных нечетких подмножеств множества Y.

Доказательство этой теоремы проводится прямым применением формулы (10). ·

Теорема 6 [2]. Если НОП

R

~

на множестве Y сильно линейно, то и индуцированное

НОП

R

~

~

сильно линейно на множестве всех нормальных нечетких подмножеств Y.

Эту теорему мы оставим без доказательства. ·

Легко проверить, что если четкое отношение является линейным, то оно является и

сильно линейным в смысле определения 21. Отсюда немедленно получаем

Следствие 1 [2]. НОП

R

~

~

, индуцируемое линейным четким бинарным отношением

R

~

на Y, сильно линейно на множестве всех нормальных нечетких подмножеств Y. ·

Однако вернемся к нашей задаче принятия решения. ЛПР выбирает действие x из

множества X, приводящее к нечеткому результату )(

~

x

j

. Предпочтения ЛПР заданы НОП

R

~

на множестве результатов Y. Тогда мы просто строим индуцированное НОП на множе-

стве X и решением задачи будет действие, максимально недоминируемое по этому НОП.

Подставляя формулу (10) для индуцированного НОП в формулу (8), получаем, что

множество недоминируемых действий имеет функцию принадлежности

26

(13)

)]).'',();',''();','(min[sup

)]'',();'','();','(min[sup(sup1)(

~

~

~

'','

~

~

~

'',''

~

~

yxyyyx

yxyyyxx

R

Yyy

R

YyyXx

НД

R

jj

jj

mmm

mmmm

Î

ÎÎ

-

--=

Если при этом образ )(

~

x

j

любого действия

Xx

Î

является нормальным нечетким

множеством, а отношение предпочтения

R

~

четкое и сильно линейное, то, по следствию 1,

и индуцированное НОП будет сильно линейным на множестве X. Для сильно линейного

НОП множество недоминируемых действий )',(inf)(

~

~

'

~

~

xxx

R

Xx

НД

R

mm

Î

= , то есть

(14)

)]'',();','(min[supinf)( ~~

'''

:'','

'

~

~

yxyxx

Ryy

Yyy

Xx

НД

R

jj

mmm

Î

Î

=

.

Несмотря на громоздкость полученных формул, рассмотренный выше подход

идейно достаточно прост – нам нужно было научиться сравнивать предпочтительность

нечетких множеств, и мы решили эту задачу с помощью индуцированного НОП.

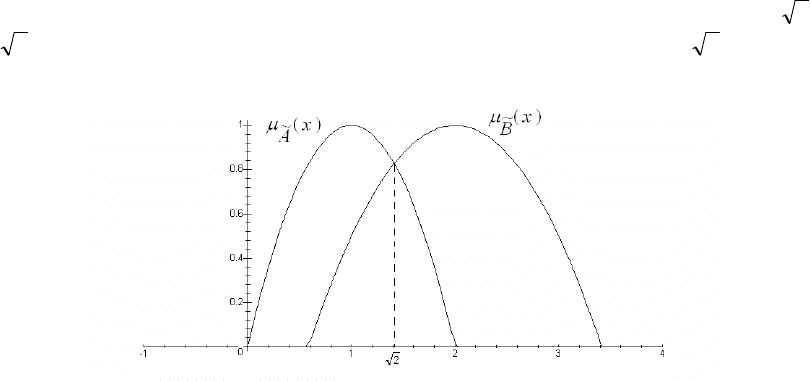

Пример 20. Вернемся к примеру со студентом, готовящимся к экзамену. Студент

выбирает уровень подготовки из множества }5;4;3;2;1{

=

X . После этого студент получает

оценку из множества }5;4;3;2;1{

=

Y в соответствии с изображенным в таблице нечетким

отображением YX

®

:

~

j

.

X

Y

1 2 3 4 5

1

1 0.6

0 0 0

2 0

1 0.6

0 0

3 0 0

1 0.7 0.1

4 0 0 0

1 0.5

5 0 0 0 0

1

Пусть, как в примере 13, предпочтения студента на множестве Y заданы обычным

четким отношением R, согласно которому оценка 2 предпочитается оценке 1, оценка 3

оценке 2 и так далее.

Найдем множество недоминируемых действий студента. Для этого вычислим ин-

дуцированное НОП на множестве действий X по формуле (12) (мы можем это сделать, так

как отношение R является четким отношением «не меньше»):

)]'',''();','(min[sup)'','( ~~

'''

~

~

yxyxxx

yy

R

jj

m

m

m

³

=

.

Полученное индуцированное нечеткое отношение предпочтения

R

~

~

на множестве

действий студента изображено в следующей таблице:

X

X

1 2 3 4 5

1

1 0.6

0 0 0

2

1 1 0.6

0 0

3

1 1 1 0.7 0.1

4

1 1 1 1 0.5

5

1 1 1 1 1

Заметим, что индуцированное НОП

R

~

~

сильно линейно и транзитивно.

Значит, множество недоминируемых действий мы можем искать по формуле

)',(inf)(

~

~

'

~

~

xxx

R

Xx

НД

R

mm

Î

= , для чего нужно всего лишь найти минимум по каждой строке матри-

цы НОП. В результате получаем

X 1 2 3 4 5

)(

~

~

x

НД

R

m

0 0 0.1 0.5 1

27

В отсутствие ограничений на действия студента множество

ЧНД

X четко недомини-

руемых действий в этом примере не пусто и, как и следовало ожидать, состоит из единст-

венного элемента – «готовиться на 5». ·

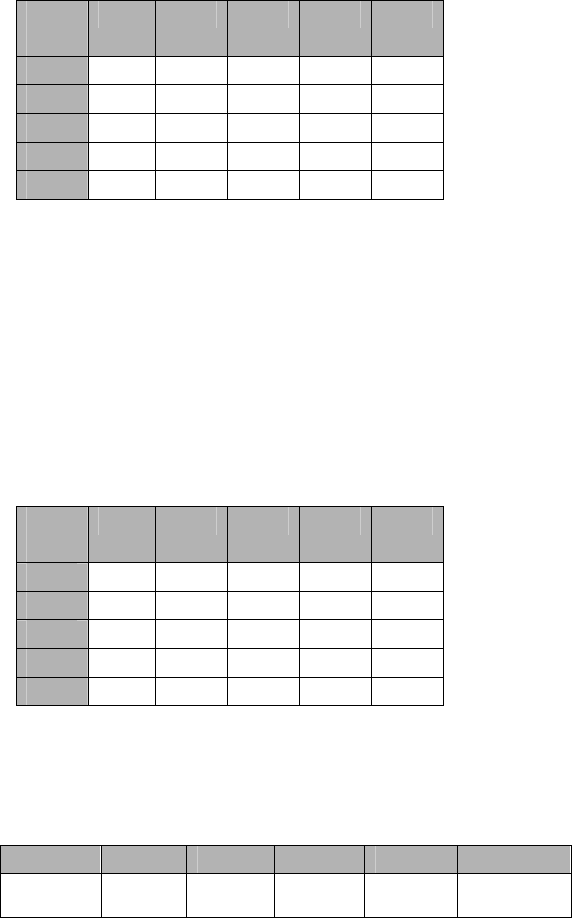

Пример 21. Найдем множество недоминируемых действий студента в случае, ко-

гда нечеткое отображение

j

~

реакции системы задано, как в примере 20, а НОП студента

на множестве оценок экзамена взято из примера 16:

R

~

y

x

1 2 3 4 5

1 1 0 0 0 0

2 0 1 0.1 0 0

3 1 1 1 0.2 0

4 1 1 0.8 1 0.3

5 1 1 1 0.7 1

По формуле (11) найдем индуцированное НОП студента на множестве действий.

Оно принимает следующий вид:

X

X

1 2 3 4 5

1

1 0.6

0 0 0

2

0.6 1 0.6 0.1 0.1

3

1 1 1 0.7 0.2

4

1 1 1 1 0.5

5

1 1 1 0.7 1

Множество же недоминируемых действий по формуле (8) равно:

X 1 2 3 4 5

)(

~

~

x

НД

R

m

0 0.1 0.2 0.8 1

В отсутствие ограничений на действия студента четко недоминируемое действие,

как и в предыдущем примере, единственно и равно «готовиться на 5».

Отметим, что в случае, когда имеются нечеткие ограничения на действия студента,

как, скажем, в примере 11, мы в общем случае не можем найти решение задачи, беря пе-

ресечение нечеткого множества недоминируемых действий и множества ограничений.

Для учета степени допустимости тех или иных действий ЛПР используется другой подход

[2], изложение которого, тем не менее, выходит за рамки настоящего курса лекций. ·

28

Лекция 4. Задача стимулирования в условиях

внешней нечеткой неопределенности

На предыдущих лекциях мы рассмотрели несколько задач принятия решений в ус-

ловиях нечеткой информации – задачу достижения нечеткой цели, задачу оптимизации

при нечетких ограничениях, а также общую задачу нечеткой оптимизации, в которой

предпочтения ЛПР описывались нечетким бинарным отношением.

Для решения последней задачи мы сформулировали понятие индуцированного не-

четкого отношения предпочтения (НОП) – по заданному НОП на множестве результатов

действий ЛПР мы построили НОП на множестве действий ЛПР и исследовали, сохраняет

ли индуцированное НОП такие свойства исходного НОП, как рефлексивность, транзитив-

ность и полнота (линейность).

Для описания нечеткого множества наилучших с точки зрения ЛПР действий мы

ввели понятие нечеткого множества недоминируемых альтернатив – множества действий,

которые строго не доминируются никакой альтернативой. Рациональным выбором ЛПР в

этой ситуации являются максимально недоминируемые действия – действия, степень при-

надлежности которых нечеткому множеству недоминируемых альтернатив максимальна.

Также были рассмотрены условия, при которых существуют четко недоминируемые аль-

тернативы (для которых эта степень принадлежности равна единице).

Все рассмотренные задачи являются задачами индивидуального принятия решений,

так как в них имеется только один целенаправленный субъект. Вся настоящая лекция бу-

дет посвящена анализу одной задачи управления организационной системой в условиях

нечеткой информации – задаче стимулирования. В ней будет уже два целенаправленных

субъекта – управляющий орган (центр) и управляемый субъект (агент).

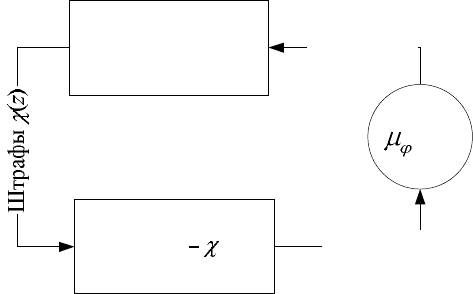

4.1. Описание модели

Центр, Ф(z)

Агент, h(z) (z)

(y,z)

Действие y

Результат z

~

Рисунок 14. Модель организационной системы с внешней нечеткой неопределенностью

Рассмотрим организационную систему [1], состоящую из центра и агента (см. ри-

сунок 14). Агент выбирает действие y из множества допустимых действий A. Это действие

приводит к некоторому результату z из множества результатов

0

A . Результат связан с дей-

ствием нечетким отображением

0

:

~

AA

®

j

с функцией принадлежности ),(~ zy

j

m

.

Предположение 1. Будем считать, что множества A и

0

A представляют собой от-

резки действительной оси.

Для фиксированного действия Ay

Î

нечеткое множество

0

)(

~

Ay

Í

j

описывает дос-

товерность реализации того или иного результата в том случае, если агент выберет дейст-

29

вие y, то есть ),(~ zy

j

m

– это достоверность реализации результата z при условии, что агент

выбрал действие y.

Предположение 2. Будем считать, что образ )(

~

y

j

любого действия Ay

Î

–

нормальное нечеткое множество, то есть для любого действия Ay

Î

найдется достоверно

реализуемый результат – такой результат

0

Az

Í

, что 1),(~

=

zy

j

m

. Кроме того, будем счи-

тать, что функция ),(~ zy

j

m

непрерывна по совокупности переменных.

Центр не наблюдает действие агента, а наблюдает только результат. Заинтересо-

ванность центра в том или ином результате описывается функцией полезности )(z

F

, агент

же в зависимости от результата z получает доход, определяемый значением функции )(zh .

В общем случае функции )(z

F

и )(zh различаются – наилучшее для центра действие мо-

жет быть невыгодным агенту. Таким образом, в системе имеет место столкновение инте-

ресов.

Для того чтобы стимулировать агента к выбору нужного действия центр имеет

возможность назначать штрафы )(z

c

в зависимости от наблюдаемого им результата z.

Предположение 3. Предполагается, что функция штрафов полунепрерывна снизу,

неотрицательна и ограничена сверху константой C, то есть для любого результата

0

Az

Í

+¥

<

£

£

Cz)(0

c

.

Таким образом, функция полезности агента представляет собой разность дохода и

затрат: )()()( zzhzf

c

-

=

.

Предположение 4. Будем считать, что функция )(zh дохода агента непрерывна,

ограничена сверху и строго однопиковая, то есть строго возрастает до некоторого значе-

ния

00

Az

Î

, после чего строго убывает.

Рассматривается задача стимулирования первого рода [1], то есть сумма штрафов,

которые центр взимает с агента, не прибавляется к функции полезности центра.

И центр, и агент знают множества A,

0

A , функции )(z

F

, )(zh и нечеткое отображе-

ние

j

~

. Поскольку ни центр, ни агент не знают точно, какой конкретный результат реали-

зуется при выборе агентом некоторого действия (связь между действием и результатом

описывается нечетким отображением

j

~

), эта задача называется задачей стимулирования с

внешней нечеткой неопределенностью. В отличие от нее в задаче стимулирования с

внутренней неопределенностью предполагается, что агент может точно предсказать ре-

зультат своих действий, а центр неточно знает функцию дохода агента [1] (эту задачу мы

рассматривать не будем).

Порядок функционирования системы следующий. Сначала центр выбирает функ-

цию штрафов )(z

c

и сообщает ее агенту. Зная зависимость штрафов от результата дейст-

вия, агент выбирает действие Ay

Î

, после чего реализуется результат

0

Az

Î

. Центр и

агент наблюдают результат z и получают доход в размере )(z

F

, )(zh соответственно, по-

сле чего центр взимает с агента штраф в размере )( z

c

.

4.2. Модель выбора агента

Для того чтобы центр мог выбрать наилучшую с его точки зрения функцию штра-

фа, он должен предсказать, какое действие выберет рациональный агент при фиксирован-

ной функции штрафа. Тогда, зная выбор агента, центр просто выберет штрафы, застав-

ляющие агента выбирать наилучшее с точки зрения центра действие. Итак, пусть штрафы

фиксированы, а значит, фиксирована и функция полезности агента )(zf .

Функция полезности агента задана на множестве результатов

0

A , а выбирать агент

должен действие из множества

A

. Чтобы выбрать наилучшее действие, агент должен

уметь сравнивать разные действия по их предпочтительности. Таким образом, чтобы оп-

ределить правило рационального выбора агента, мы должны найти нечеткое отношение