Ломакин Д.В., Туркин А.И. Прикладная теория информации и кодирования

Подождите немного. Документ загружается.

PB P

n

q

nn

k

()=

−

11

.

В результате тождественных преобразований

PB p q

pq

p

q

k

npnnp nqnnnq

np nq

nnp

()

.

() ( )

()

==

=

⎛

⎝

⎜

⎞

⎠

⎟

+− +−−

−

11

1

I

Прологарифмировав последнее равенство, получим

log

m

P(B

k

)=nplog

m

p+nqlog

m

q+

+− =−− − −

−

−

=− −

( ) log [ log log

log ] [ ( ) ( )],

nnp

p

q

np pq q

nnp

n

p

q

nH x On

mmm

m

1

1

где величина

H(x)=-plog

m

p-qlog

m

q

является характеристикой источника сообщений и на-

зывается э н т р о п и е й .

Покажем, что в случае типичных последовательно-

стей остаточным членом

О (п) по сравнению с вели-

чиной

H(X)можно пpенебречь.

Поскольку для типичных последовательностей

справедли-во неравенство

nnpn

1

−<ε,то

On n

p

q

n

p

q

mm

() ()log log

,

<=

−+

ε

δ05

Следовательно,

lim ( )

n

On

→∞

=

≠

≠

0 (p 0,q 0) .

Таким образом, при достаточно большом

п спра-

ведливо приближенное равенство

lo

g

() ()

m

k

P

Bn

H

X

≈

−

.

Отсюда вероятность появления отдельной типичной

последовательности

PB m

k

nH X

()

()

≈

−

.

Поскольку правая часть равенства не зависит от но-

мера типичной последовательности

k, то все типич-

ные последовательности примерно равновероятны.

Вероятность появления типичной последовательности

PPBQm

Tk

nH X

k

Q

== ≈

−

=

∑

() ,

()

1

0

где суммирование ведется по всему множеству ти-

пичных

последовательностей. Отсюда.

Q=m

nH(X)

,

причем единица измерения энтропии

Н (X) совпадает

с основанием степени

т. Поскольку количество ин-

формации, нужное для определения числа (состояния

регистра), равно

logQ, энтропия HX

Q

n

()

log

= равна количеству ин-

формации

,

которое необходимо для определения состояния од-

ного разряда.

Аналогично определяется количество типичных

последовательностей, вырабатываемых источником с

алфавитом размера

т

X

, только в этом случае энтро-

пия

HX px px

ii

i

m

X

() ()log()=−

=

∑

1

.

СВОЙСТВА ЭНТРОПИИ

Энтропия

HX p p

ii

i

m

X

() log=− ≥

=

∑

0

1

,

поскольку p

i

удовлетворяет неравенству 01

≤

≤

p

i

.

Энтропия

H(Х)=0,когда система находится в одном из

состояний с вероятностью, равной единице, и во всех

остальных—с вероятностью, равной нулю. При этом

имеется в виду, что

li

m

log

p

i

ii

pp

→∞

=

0.

При равномерном распределении

p

m

i

X

=

⎛

⎝

⎜

⎜

⎞

⎠

⎟

⎟

1

энтро-

пия

(

X)=log m

x

Докажем, что это максимальное значение энтро-

пии.Исполь-

зуя равенство

p

i

i

m

X

=

=

∑

1

0

, можно выполнить следующие

тождественные преобразования :

HX m p

p

Xi

i

m

X

i

()log log−= −

=

∑

1

1

−=−

⎛

⎝

⎜

⎜

⎞

⎠

⎟

⎟

=

==

∑∑

pm p

p

m

i

i

m

X

Xi

i

X

i

m

X

11

1

log log log

=

=

∑

p

pm

i

iX

i

m

X

log

1

1

для оценки выражения log

1

pm

iX

воспользуемся нера-

венст-вом

ln ,zz

pm

iX

≤−1 положив z=

1

.

Заменяя

log log

1

1

pm pm

e

iX iX

на

1

−

⎛

⎝

⎜

⎜

⎞

⎠

⎟

⎟

, получим

HX m p

pm

e

Xi

iX

i

m

X

()log log−≤ −

⎛

⎝

⎜

⎜

⎞

⎠

⎟

⎟

=

=

∑

1

1

1

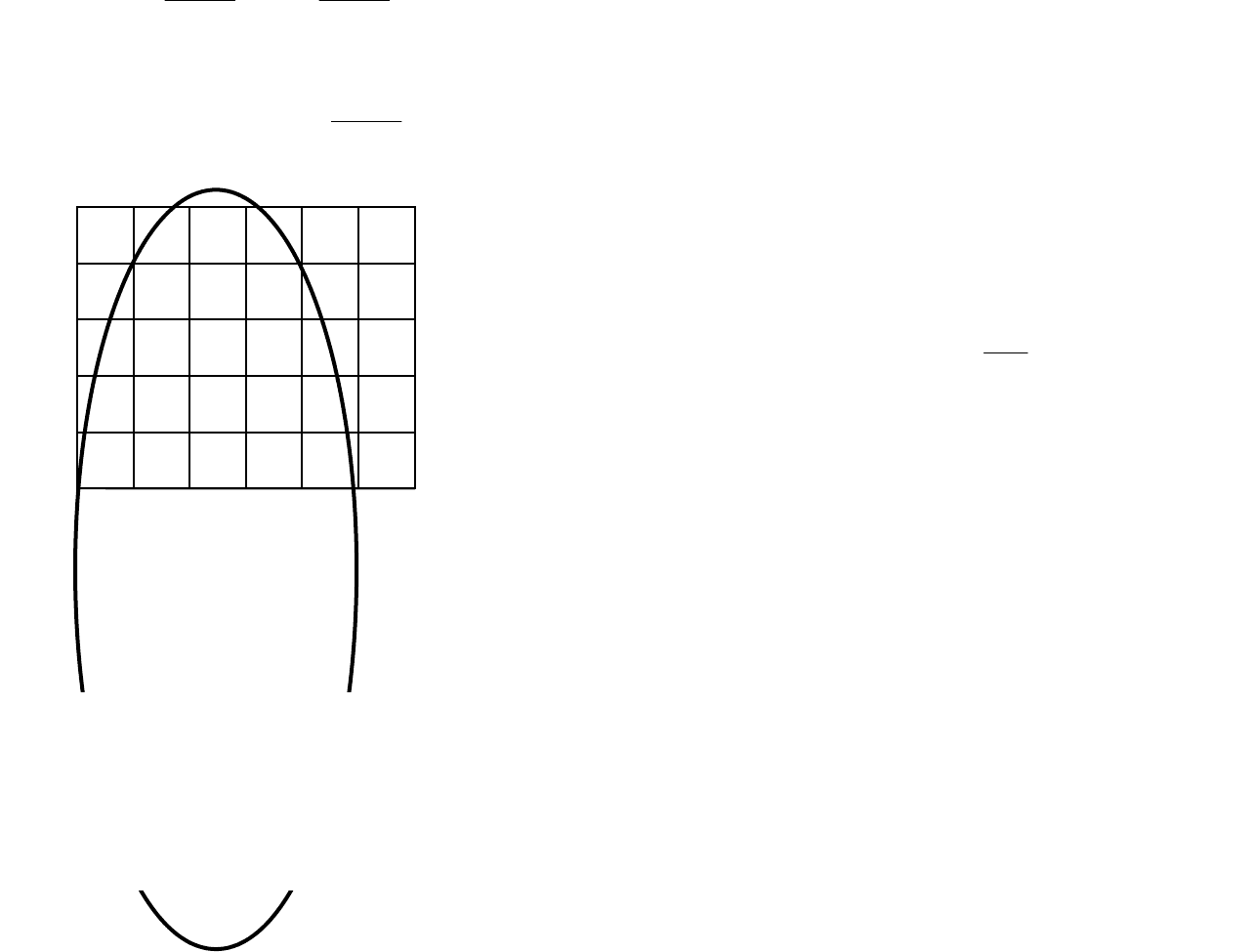

H 1

0,8

0,6

рис.1 Энтропия

системы

0,4 с двумя со-

стояниями :

p - вероят-

ность одно-

0,2 го из состоя-

ний

0 0,2 0,4 0,6 0,8 1 P

=−

⎛

⎝

⎜

⎜

⎞

⎠

⎟

⎟

=− =

==

∑∑

1

11 0

11

m

pe e

X

i

i

m

i

i

m

i

log ( ) log ,

где log e- модуль перехода . Отсюда

H

Xm

X

() log

≤

.

Пусть множество

Х состоит из двух элементов, ко-

торые обозначим через единицу и ноль, причем еди-

ница позволяет-

ся с вероятностью, равной

р, а ноль — с вероятно-

стью, равной

q=1—р. Тогда

H

Xpp p p() lo

g

()log()

=

−

−

−

−

11.

Указанная зависимость изображена на рис. 1. Макси-

мум достигается при

p=q==0,5.

ЦЕННОСТЬ ИНФОРМАЦИИ

Все определения ценности информации связаны с

понятием цели. Ценной считается та информация, ко-

торая способствует достижению поставленной цели.

Один из способов измерения ценности информа-

ции, сформулированный в рамках статистической

теории информации, был предложен А. А. Харкеви-

чем [3]. Ценность информации может быть выражена

через приращение вероятности достижения цели. Ес-

ли значение

априорной вероятности достижения цели

обозначить через

p

i

, а апостериорной — через р

2

, то

ценность полученной информации можно определить

как

log

p

p

2

1

.

В системах передачи информации цель сводится к

правильной передаче сообщений независимо от их

конкретного содержания и формулируется относи-

тельно каждого символа множества

X. Пусть целью

является принятие решения в пользу

x

i

. Тогда относи-

тельно этой цели ценность сведений,

содержащихся в принятом

у

1

равна log

(| )

()

px y

px

ij

i

, где

p(x

i

) — априорная вероятность передачи x

i

, p(x

i

|y

j

) —

вероятность того, что было передано

x

i

после приня-

тия

у

j

. При такой формулировке цели ценность ин-

формации совпадает с обычным количеством инфор-

мации, которое определено выше.

Таким образом, количество информации, которое

у

j

, несет об x

i

, равно

Iy x

px y

px

ji

ij

i

(,) log

(| )

()

=

Умножая числитель и знаменатель под логарифмом

на

p(y

j

) и учитывая равенства

p

x

y

p

y

p

x

y

p

y

x

p

x

ij j i j ji i

( | )( ) ( , ) ( | )( )

=

=

,

получим

Iy x

p

x

y

px

p

x

y

px py

py x

py

Ix y

ji

ij

i

ij

ij

ji

j

ij

(,)

(| )

()

log

(, )

()( )

log

(|)

()

(, ).

== =

==

(3)

Отсюда следует, что у

j

несет об x

i

такое же количест-

во информации, какое

x

i

несет об у

j

(свойство сим-

метрии). Поэтому

I (x

i

,у

j

) называется взаимным коли-

чеством информации между

i-м символом множества

Х и j-м символом множества Y. Взаимное количество

информации I(x

i

,у

j

) может быть положительным

(

p(x

i

|y

j

)>p(x

i

)), отрицательным (p(x

i

|y

j

)<p(x

i

)) и равным

нулю (

p(x

i

|y

j

)=p(x

i

)). Отрицательная информация на-

зывается д е з и н ф о р м а ц и е й.

СОБСТВЕННАЯ ИНФОРМАЦИЯ И ЭНТРОПИЯ

Пусть в канале отсутствуют помехи. Тогда между

элементами множеств

X и Y имеет место взаимно од-

нозначное соответствие и

p(x

i

|y

j

)=1 при i=j. В этих ус-

ловиях количество информации, которое

у

j

(j=i) дос-

тавляет об

x

i

, согласно (3) равно

I(x

i

)= - log p(x

i

)= - log p(y

j

).

Эта величина называется собственным количеством

информации, которое несет символ

x

i

, причем всегда

I(x

i

) >0. Усредняя I(x

i

) по всему множеству X, получим

количество информации, которое в среднем несут со-

общения множества

X. Среднее значение совпадает с

энтропией

HX pIx p p

ii i i

i

X

m

i

X

m

() () log==−

==

∑∑

11

,

где pp

x

ii

= ().

ВЗАИМНАЯ ИНФОРМАЦИЯ

Источник информации и приемник можно рассматри-

вать как подсистемы одной сложной системы. Взаим-

ную информацию между состояниями подсистем, ис-

пользуя (3), можно записать в виде

I

y

x

p

x

p

x

y

px py px y

py py x Ix y

ji i ij

ij ij

jjiij

( , ) log ( ) [ log ( | )]

log ( ) log ( ) [ log ( , )]

log ( ) [ log ( | )] ( , )

=

−

−

−

=

=− − − − =

=− − − =

. (4)

Поскольку сложная система случайным образом при-

ходит в

то или иное состояние, определяемое парой

чисел

(x

i

, y

j

), то I(x

i

, y

j

) будет случайной величиной,

которую можно усреднить по всему множеству со-

стояний. В результате почленного усреднения (4) по-

лучим выражение для средней (полной) взаимной ин-

формации:

I

YX

H

X

H

XY

H

X

H

Y

H

XY(, ) ( ) ( |) ( ) () ( ,)

=

−

=

+

−

=

=

−

=

H

Y

H

YX

I

XY() (| ) ( ,),

(5)

где

IYX px y Ix y

ij

j

m

Y

ij

i

m

X

(, ) ( , )( , );=

==

∑∑

11

HXY px y pxy

ij ij

j

m

Y

i

m

X

(|) (, )log(| );=−

==

∑∑

11

HYX px y py x

ij

j

m

Y

ji

i

m

X

(| ) ( , )log ( | ).=−

==

∑∑

11

С точки зрения информационного описания систе-

мы связи безразлично, какую из подсистем рассмат-

ривать в качестве передатчика, а какую в качестве

приемника.

Поэтому энтропии

Н(Х) и H(Y) можно интерпрети-

ровать как информацию, которая поступает в канал

связи, а условные энтропии

H(X/Y), H(Y/X) как ин-

формацию, которая рассеивается в канале. В [1] дока-

зано, что

I(Х,Y)>0.

При выполнении указанного неравенства из (5) сле-

дует, что

H

XY

H

X

HYX HY

HXY HX HY

(|) (),

(| ) (),

(,) () ().

≤

≤

≤+

Условную энтропию можно представить в виде

HXY py pxy pxy py HXy

jij

i

m

X

ij j j

j

m

Y

j

m

Y

(|) ( ) (| )log(| ) ()(| ),=− =

===

∑∑∑

111

где величина

HXy pxy pxy

jijij

j

m

X

(|) (|)log(|)=−

=

∑

1

называется ч а с т н о й у с л о в н о й э н т р о п и е й.

Она характеризует неопределенность состояния сис-

темы А в случае, когда известно состояние

у у наблю-

даемой системы В. Зафиксировав состояние

у

j

систе-

мы В, мы тем самым изменяем комплекс условий,

при

которых может реализоваться событие x

i

. Это обна-

руживается как изменение вероятности реализации

события x

i

(,)in= 1

(имеет место статистическая зави-

симость). Если до изменения условий указанная веро-

ятность была равна безусловной (полной) вероятно-

сти p(x

i

), то после изменения условий она стала рав-

ной условной вероятности р(x

i

,y

j

). При отсутствии

статистической зависимости Н(X| у

j

) = Í(Õ), посколь-

ку

p

x

y

p

x

ij i

(| ) ().

=

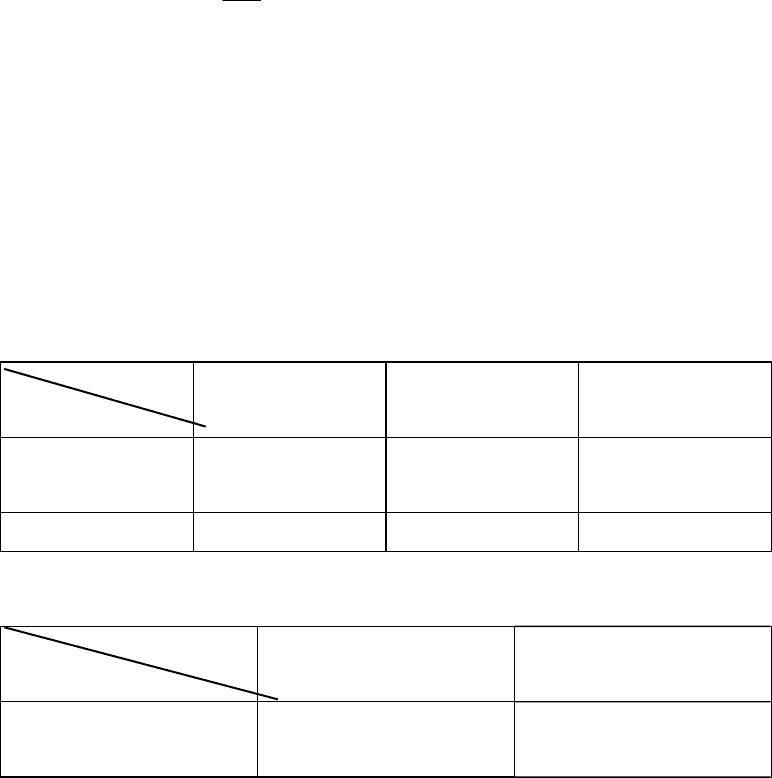

Таблица 1

X

y

x

1

x

2

p(y

j

)

y

1

y

2

0,5

0,25

0

0,25

0,5

0,5

p(x

i

) 0,75 0,25

Таблица 2

X

y

x

1

x

2

y

1

y

2

1

0,5

0

0,5

При наличии статистической зависимости энтропия

Н(Х|у

j

) может оказаться как меньше, так и больше

Н(Х). Напомним, что для энтропии H(X|Y) всегда

справедливо неравенство

H

XY

H

X(|) ()≤ .

В качестве примера вычислим энтропии Н(X),

H(X|Y), H(X|y

j

) и взаимную информацию I(X, Y) , ко-

гда системы А и В описываются двумерным распре-

делением р(x

i

, у

j

), заданным в виде табл. 1. Вычислен-

ные значения условной вероятности

px y

px y

py

ij

ij

j

(| )

(, )

()

=

записаны в табл. 2

Используя записанные в таблицах значения вероят-

ностей, получим

H

Xy p

x

yp

x

yp

x

yp

x

y(|) (|)log(|) (|)lo

g

(|)

111112121

=−

−

=

=

−

−

=

110 00lo

g

lo

g

,

H

Xy p

x

yp

x

yp

x

y

x

y(|) (|)log(|) (|)log(|)

212122222

=−

−

=

=

−

+

=

(,lo

g

,,log,),05 05 05 05 1

H

XY py

H

Xy py

H

Xy(|) ()(|) ( )(| ) , , ,,=+

=

⋅

+

⋅

=

112 2

05 0 05 1 05

H

X() (, lo

g

,,lo

g

,) , ,=− +

≈

025 025 075 075 0811

I

XY

H

X

H

XY(,) () (|) , , , .=

−

≈

−

=

>0 811 0 5 0 311 0

Отсюда

HXy HX HXy

HX HXY

(|)()(|),

,,

() (|),

,,.

12

008111

0811 05

<

<

<<

>

>

3. ДИСКРЕТНЫЕ ИСТОЧНИКИ СООБЩЕ-

НИЙ И ИХ ОПИСАНИЕ

ЭРГОДИЧЕСКИЕ ИСТОЧНИКИ

Источник будем называть эргодическим, если его

вероятностные параметры можно оценить по одной

достаточно длинной реализации, которую он выраба-

тывает. При неограниченном возрастании длины реа-

лизации (п) оценка параметра (результат измерения)

совпадает с его истинным значением с вероятностью,

равной единице. Например, при бросании игральной

кости можно оценить вероятность выпа-дания какой

-

либо цифры через относительную частоту ее появле-

ния в достаточно длинной серии испытаний. Указан-

ная серия испытаний представляет собой ту самую

реализацию, по которой осуществляется оценка веро-

ятности (параметра). Реализации, по которым можно

оценить закон распределения, являются типичными.

Поэтому эргодическим источником можно назвать

источник, который вырабатывает типичные последо-

вательности. Типичная

последовательность несет све-

дения о структуре источника, то есть является типич-

ной для данного источника. Если два источника раз-

личаюгся своей структурой (значением оцениваемого

параметра), то, наблюдая реализацию, можно опреде-

лить, какому из них она принадлежит. Источник, эр-

годический по одному параметру, может оказаться не

эргодическим по другому параметру.

ПРОИЗВОДИТЕЛЬНОСТЬ ДИСКРЕТНОГО ИС-

ТОЧНИКА СООБЩЕНИЙ

Кодовое слово, которое вырабатывает источник,

будем записывать в виде

x

x

x

x

x

i

ii i

k

i

n

i

л

k

где

12

,,...,..., , −−

ÿ буква

(символ) алфавита с k порядковым номером в слове.

Например, пусть k=5, a i

5

==3. Это значит, что пятой

буквой в слове является третья буква алфавита. Обо-

значим через Х

k

множество букв (алфавит), из кото-

рых выбирается k-ÿ буква

слова. В нашем случае все множества X

k

(k=1,n) со-

стоят из одних и тех же т

x

букв. Когда не требуется

указывать место буквы в слове, i-þ букву алфавита

будем обозначать через x

i

.

Количество информации, которое в среднем несет от-

дельное слово, равно энтропии

H

XX p

x

x

p

x

x

nii

n

ii

n

( ,..., ) ( ,... )lo

g

( ,... )

1

11

=

−

∑

,

где суммирование ведется по всему множеству слов.

Определим производительность источника Н

И

как

предел отношения

количества информации, которое в среднем несет от-

дельно слово, к числу букв в слове п при неограни-

ченном возраста нии п:

H

HX X

n

И

n

n

=

→∞

lim

( ,..., )

1

(6)

Если буквы в слове статистически независимы (ве-

роят- ность выбора очередной буквы не зависит от

состава пред шествующих ей букв), то

H

XX

H

X

H

X

H

X

n

k

n

( ,..., ) ( ) ... ( )... ( ),

11

=

+

+

+

где

H X px px

ki

k

i

k

i

k

m

X

() ()log()=−

=

∑

1

.

Источник со статистически независимыми буквами

сообщений будет стационарным, если вероятность

выбора 1-й буквы алфавита не зависит от того, какое

место в слове она занимает

(( ) ( ))p

x

p

x

i

k

i

=

.

В этом случае

H(X

1

,...,X

n

)=nH(x)

н производительность источника (бит/символ)

HHX px px

И ii

i

m

X

==−

=

∑

() ()log()

1

.

Часто производительность источника измеряется

количеством информации

ν

H

X()

, которое он выраба-

тывает за одну секунду (

ν—количество букв за одну

секунду). Максимальная производительность источ-

ника достигается, когда все буквы алфавита появля-

ются с равными вероятностями. В этом случае

H

m

И

X

= log .

МАРКОВСКИЕ ИСТОЧНИКИ СООБЩЕНИЙ

Рассмотренная модель дискретного источника со-

общений имеет сравнительно узкую область приме-

нения, поскольку реальные источники вырабатывают

слова при наличии статистической зависимости меж-

ду буквами. В реальных источниках вероятность вы-

бора какой-либо очередной буквы зависит от всех

предшествующих букв. Многие реальные источники

достаточно хорошо описываются марковскими моде-

лями источника сообщений.

Согласно указанной мо-

дели условная вероятность выбора источником оче-

редной

x

i

k

, буквы зависит

только от

ν предшествующих. Математической мо-

делью сообщений, вырабатываемых таким источни-

ком, являются цепи Маркова

ν

-ãî порядка. В рамках

указанной модели условная вероятность выбора i

k

-й

буквы

p

x

x

x

x

p

x

x

x

i

k

i

k

i

k

ii

k

i

k

i

k

( | ..., ,..., ) ( | ,..., )

−−− − −

=

νν ν11 1

.

Если последнее равенство не зависит от времени, то

есть справедливо при любом значении k, источник на-

зывается однородным. Однородный марковский ис-

точник называется стационарным, если безусловная

вероятность выбора очередной буквы не зависит от k

(( ) ( ))p

x

p

x

i

k

i

= . В дальнейшем будем иметь дело

только со стационарными источниками. Вычислим

производительность источника для простой цепи

Маркова (

ν

=l). В этом случае вероятность

p

x

x

p

x

p

x

x

p

x

x

ii

n

iii i

n

i

n

(,..., ) ()(|)...(| )

11211

=

−

.

Прологарифмировав последнее равенство, получим

−

=

−

−

−

−

−

log ( ... ) log ( ) log ( | ) ... log( |

)

p

x

x

p

x

p

x

x

x

x

ii

n

iii i

n

i

n11211

.

Это равенство показывает, что индивидуальное ко-

личество информации, которое несет слово, равно ко-

личеству информации, которое неcет первая буква,

плюс количество информации, которое несет вторая

буква при условии, что первая буква уже принята, и т.

д.

Усредняя равенство по всем словам, получим коли-

чество информации, которое в среднем несет каждое

слово:

H

XX

H

X

H

XX

H

XX

nnn

( ,..., ) ( ) ( | ) ... ( | )

1121 1

=

+

+

+

−

.

Поскольку источник стационарный, то энтропия не

зависит от k и равна

H

XX

H

Xn

H

XX n

H

X

n

k

k

(,..., ) ()( )(| ) ()

11 1

1

=

+−

≤

−

.

Подставляя полученный результат в (6) и учитывая,

что всегда

H

Xm

X

() log

≤

, имеем

H

HX

n

n

n

HX X HX X

И

n

kk kk

=+

−

⎛

⎝

⎜

⎞

⎠

⎟

=

→∞

−−

lim

()

(| ) (| )

1

11

.

В случае марковской цепи

ν-ãî порядка H

и

вычисля-

ется аналогично и равна Н

И

=Н(Х

ν

+1

|X

ν

,..., X

1

).

Таким образом, производительность марковского

источника равна неопределенности выбора очередной

буквы при

УСЛОВИИ, что известны v предшествую-

щих.

Для производительности марковского источника

всегда справедливо неравенство

H

H

Xm

И

X

≤

≤

() log .

Максимального значения, равного logm

X

, производи-

тельность источника достигает, когда отсутствует

статистическая зависимость между буквами в слове и

когда все буквы алфавита вырабатываются с равными

вероятностями. Очевидно, максимальная производи-

тельность источника полностью определяется раз-

мером алфавита т

X

.

Для того чтобы характеризовать, насколько полно

использует источник возможности алфавита, вводится

параметр

r

HXH

HX

И

=

−

max

max

()

()

называемый и з б ы т о ч н о с т ь ю.

Для передачи заданного количества информации,

равного I, требуется п=I/H

И

букв, если производи-

тельность источника равна H

И

. В случае, когда произ-

водительность источника достигает своего макси-

мального значения, равного H

max

(X)= =logm

X

, для

передачи того же количества информации I требуется

минимальное количество букв, равное п

0

=I/Н

max

(X).

Отсюда I=пН

И

=п

0

Н

max

или

H

HX

n

n

И

max

()

=

0

. Учитывая

пос-леднее равенство, выражение для. избыточности

можно записать в виде