Вернер М. Основы кодирования

Подождите немного. Документ загружается.

4-3.

Выводы

этому, понятия условной информации и условной энтропии вполне

естественно выводятся из условной вероятности.

Взаимная информация не имеет аналога в теории вероятности.

Это совершенно новое понятие теории информации, играющее цен-

тральную роль в информационной технике. Взаимная информация

связывает понятие канала с возможностью передачи информации по

нему, т.е. с его пропускной способностью. Это понятие

будет

подроб-

но

рассмотрено в 7

главе

этой книги.

ГЛАВА 5

СТАЦИОНАРНЫЕ

ДИСКРЕТНЫЕ

ИСТОЧНИКИ

С

ПАМЯТЬЮ

5.1.

Энтропия

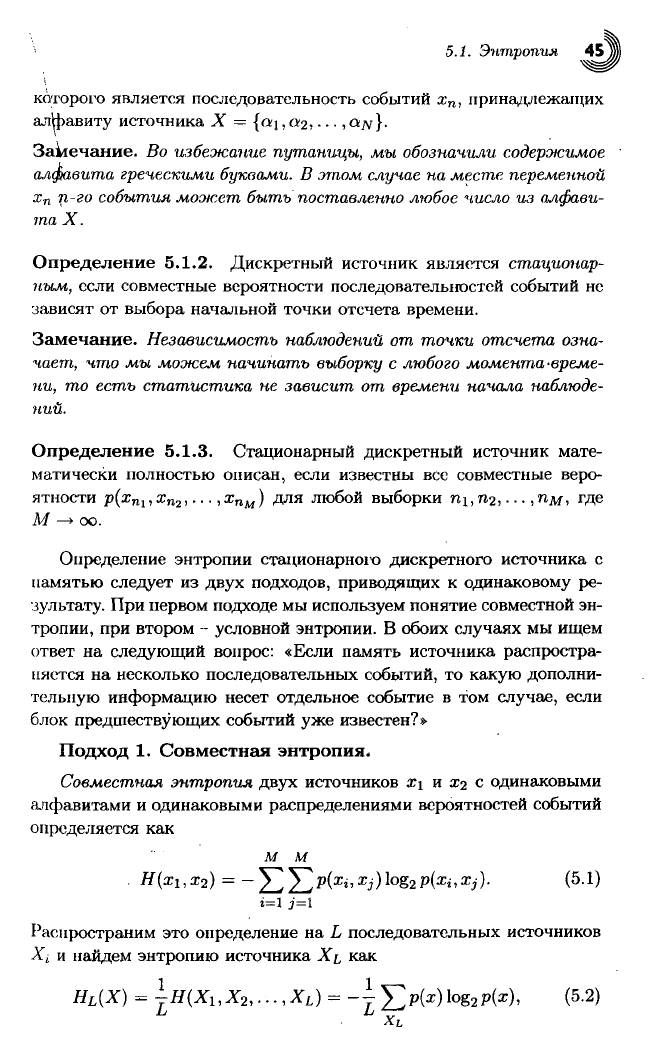

Сигналы

аналоговых

источников

информации

ограничены по поло-

се,

поэтому коррелированы во времени. Примером может служить

аналоговый речевой сигнал в телефонной линии. После оцифров-

ки,

аналоговый источник превращается в дискретный и, например,

после квантования сигнала на 256 уровней, мы получаем последо-

вательнось 8-ми битовых двоичных целых чисел от 0 до 255. Как

видно из рис. 5.1, значение

двух

соседних чисел близки

друг

к дру-

гу, т.к. телефонный сигнал передается в узкой полосе частот. Из-

за временной связи соседних отсчетов, то есть памяти отсчета, его

неопределенность (информация) снижается по сравнению с анало-

говым источником без памяти, поэтому основной задачей методов

сжатия, особенно при передаче видеосигналов, является снижение

избыточности.

III!!

i

i i i

Jf

i

%

(

j •

IT

i

:

\y

r-

{

i

-

[

\

; ;

; I

i!

i

:

\\c

lo

-

л

Рис.

5.1. Непрерывный сигнал.

Возникает вопрос о том, каким образом определить энтропию

дискретного

источника

с

памятью.

Начнем с постановки задачи.

Определение 5.1.1.

Дискретный

источник

X можно представить

как

дискретный

во

времени

стохастический

процесс,

реализацией

5.1.

Энтропия

которого является последовательность событий

х

п

,

принадлежащих

алфавиту источника

X =

{оц,

«2,...,

адг}-

Замечание.

Во

избежание

путаницы,

мы

обозначили

содержимое

алфавита

греческими

буквами.

В

этом

случае

на

месте

переменной

х

п

п-го

события

может

быть

поставленно

любое

число

из

алфави-

та

X.

Определение 5.1.2. Дискретный источник является

стационар-

ным, если совместные вероятности последовательностей событий

не

зависят

от

выбора начальной точки отсчета времени.

Замечание.

Независимость

наблюдений

от

точки

отсчета

озна-

чает,

что мы

можем

начинать

выборку

с

любого

момента-време-

ни,

то

есть

статистика

не

зависит

от

времени

начала

наблюде-

}шй.

Определение

5.1.3. Стационарный дискретный источник мате-

матически полностью описан, если известны

все

совместные веро-

ятности

р(х

П1

, х

П2

,...,

х

пм

)

для

любой

выборки

пх,П2,...,пм,

где

М

—>

оо.

Определение энтропии стационарного дискретного источника

с

памятью

следует

из

двух

подходов, приводящих

к

одинаковому

ре-

зультату.

При первом подходе мы используем понятие совместной эн-

тропии,

при втором

-

условной энтропии.

В

обоих случаях мы ищем

ответ

на

следующий вопрос: «Если память источника распростра-

няется

на

несколько последовательных событий,

то

какую дополни-

тельную информацию несет отдельное событие

в том

случае, если

блок предшествующих событий

уже

известен?»

Подход

1. Совместная энтропия.

Совместная

энтропия

двух

источников

Х\ и xi с

одинаковыми

алфавитами

и

одинаковыми распределениями вероятностей событий

определяется

как

м

м

H(X1,X

2

)

=

-^2^2p(Xi,Xj)log2P(Xi,Xj).

(5.1)

Распространим это определение

на L

последовательных источников

Xi

и

найдем энтропию источника

Xi как

i

^, (5.2)

Глава

5.

Стационарные

дискретные

источники

с

памятью

/

j

где вектор

X =

(х\,х

2

, • • •

,£/,) и

суммирование производится

по

вс^м

возможным компонентам вектора

X.

Устремляя

L к

бесконечнос+и,

мы полностью охватим память источника

и

получим предельное зна-

чение

Hi(X)

(если

оно

существует), равное

i

Яоо(Х)

= lim

H(X

L

).

(5.3)

L—юо

Подход

2. Условная энтропия.

Условная

энтропия

L-того события

в

случае, если

L

—

1

предше-

ствующих событий

уже

известны, определяется

как

Н

О0

{Х)=

lim

H(X

L

/X

1

,X

2

,...,X

L

_

1

).

(5.4)

L—too

Хотя

в

левых частях равенств

(5.3) и (5.4) мы уже

использовали

оди-

наковое обозначение энтропии отдельного события, этот факт пред-

стоит доказать. Проведем

это

доказательство

за 4

шага.

Теорема

5.1.1.

Для

стационарного дискретного источника

с Hi{x) <

ос имеет место:

1.

H(Xi\Xi,

X2,

• •

•,

XL^I) не

возрастает

с

ростом длины блока

L;

2.H

L

(X)>H(X

L

\Xi,X

2

,...,X

L

-

1

);

3.

HL(X) не

возрастает

с

ростом длины блока

L;

4. Энтропия стационарного дискретного источника

HL(X)

lim

H

L

(X) = lim ff(X

t

|Xi,X

2

,...,X

L

_i)

=ЯооР0.

L—too

L—too

Доказательство.

1.

Из

определения энтропии,

как

меры неопределенности источ-

ника,

непосредственно следует,

что

возрастание числа ограничений

не

может повлечь

за

собой рост неопределенности,

а

следовательно

и

энтропии.

2.

Из

«правила цепочки»

для

совместной энтронии

следует

j[H(X

1

)

+

H(X

2

\X

1

)

+

---

+

Li

. (5.5)

+

H(X

L

\X

1

,X

2

,...,X

L

^)].

Замечание.

«Правило

цепочки»

для

совместной

энтропии

следует

из

«правила

цепочки»

для

вероятностей.

Простейший

пример

«пра-

вила

цепочки»

для

вероятностей

р(х, у) =

р(х/у)р(у)

и р(х, у, z) =

p(x/yz)p(y/z)p(z). Так

как

логарифмическая

функция

отображлет

произведение

в

сумму,

получаем

«правило

цепочки»

для

совместной

энтропии.

5.1.

Энтропия

AT,

,

Так как энтропия всегда неотрицательна и имеет место неравен-

ство

\

откуда

следует

нижняя оценка

2.

3. Из (5.5) прежде всего

следует

разложение

HUX)

=

^-Н,^(Х)

+

jH(X

L

\X

1

,X

2

,

...,X

L

-

X

).

(5.7)

LJ

Li

Используя

уже известное соотношение (5.5), получаем неравенство

L.HUX)<(L-l)-H

L

-

l

(X)+H

L

(X).

(5.8)

После

подстановки

получаем

утверждение

3.

H

L

(X)

<

H

L

^{X).

. (5.9)

4. Утверждения 1.,

2. и

ограничение Н\{Х)

<

оо устанавливают

существование предела. Используя далее «правило цепочки», полу-

чаем

тт

/V"\

Г

LT/

V V V \ |

/>

-f" 7

+

ff(Xi,|Xi, X

2

,..., X

b

-i) +

Я(Х

ь+1

|^1,

Jf

2

,

• •

•,

X

L

)+

+ •••+

H(X

L+J

\X

U

X

2

,...,

X

L+i

.i)\.

(5.10)

Согласно утверждению 1., условная энтропия

в

правой части .ра-

венства не возрастает, поэтому справедлива оценка

1

H

L+j

(X)

<

~^

l±lH{X

L

/\X

1

,X

i

,...,X

L

-

1

).

(5.11)

L

j

Устремляя

j к

бесконечности,

получим

lira

H

L+j

{X)< lim

—"—

H(X

U

X

2

,..

•

,X

L

.-i)+

j-»oo

j->oa

L+J

+

i±±H(X

L

\X

1

,X

2

,...,X

L

.

l

),

(5.12)

L

+ J

что дает для каждого натурального

L,

Яоо<Я(Хь|А-1,Х

2

,...

1

Х

1

,_1), (5.13)

но,

т.к. для любого натурального

L

выполняется так же и 2., то 5.13

превращается

в

равенство при

L

—» оо.

•

Глава 5. Стационарные дискретные источники с памятью I

5.2.

Теорема кодирования источников

2 /

Теперь мы можем дополнить теорию информации еще одной теоре-

мой.

Окалывается, что объединяя события источника в блоки длимы

L

и кодируя эти блоки, средняя длина кодового слова на событие

может достигнуть энтропию источника Н

х

(х) при

L—>оо

как угодно

близко.

При этом память источника полностью учитывается.

Теорема 5.2.1.

Теорема

кодирования

стационарного дискретного ис-

точника с энтропией Hi(X).

Для блока длины L

существует

.D-ичный префиксный код, в кото-

ром средняя длина кодового слова на одно событие п удовлетворяет

неравенству

М§^§ 1

(5.14)

Теорема

(5.14)

не нуждается в специальном доказательстве. Если

мы рассматриваем блоки длины L как новые независимые события

с энтропией, равной L

•

HL{X) И применяем теорему кодирования

источников 1, то мы имеем

^1

1.

(5.15)

Разделив все члены неравенства на L, получаем среднюю длину ко-

дового слова на событие

)^ШЛ.

(5.16)

При

L —» оо, Hi(x) —» Нос(х) = Н(х) мы имеем

LH

L

(X)

LH

L

{X)

(517)

+

6

-

(5Л8)

Таким образом, для любого сколь угодно малого S,

существует

метод кодирования блоков, содержащих L > 1/6 событий, при кото-

ром для средней длины кодового слова на событие п выполняется

неравенство (5.18). Теорема кодирования источников 2 показывает,

что увеличивая длину блока L, мы можем как угодно близко подойти

к

энтропии Н(х) =

Н

оо

(х).

Однако, на практике

существуют

неко-

торые ограничения. Для того, чтобы блок из L событий мог быть

5.3. Конечные цепи Маркова

I

' продекодирован, он должен быть полностью принят, что может при-

вести

к

недопустимым задержкам декодирования

и

недопустимому

Объему буфера памяти.

5.3.

Конечные

цепи

Маркова

В этом

и

последующих параграфах

будет

рассматриваться специ-

альная форма дискретных источников

с

памятью марковские ис-

точники.

Их

описание сходно

с

марковскими цепями, которые

на-

шли разнообразное применение

в

других

областях науки

и

техники.

Гак, на основе марковских цепей строятся модели распознавания

ре-

чи,

модели передачи

по

телефонным коммутируемым каналам.

Це-

ни

Маркова

1

используются

при

исследовании моделей сетей связи

(каналы

Гильберта-Элиота)

и в

теории управления транспортными

потоками.

Значение цепей Маркова основывается

не

только

на их

полном математическом описании, но также

на

том факте,

что с их

помощью можно составить математическую модель многих процес-

сов,

наиболее близкую

к

практике.

5.3.1.

Дискретные

во

времени

цепи

Маркова

В этом разделе

шаг за

шагом вводится понятие конечных дискрет-

ных

во

времени марковских цепей. Мы наглядно поясним

это

поня-

тие

на

простейшем примере «случайных блужданий».

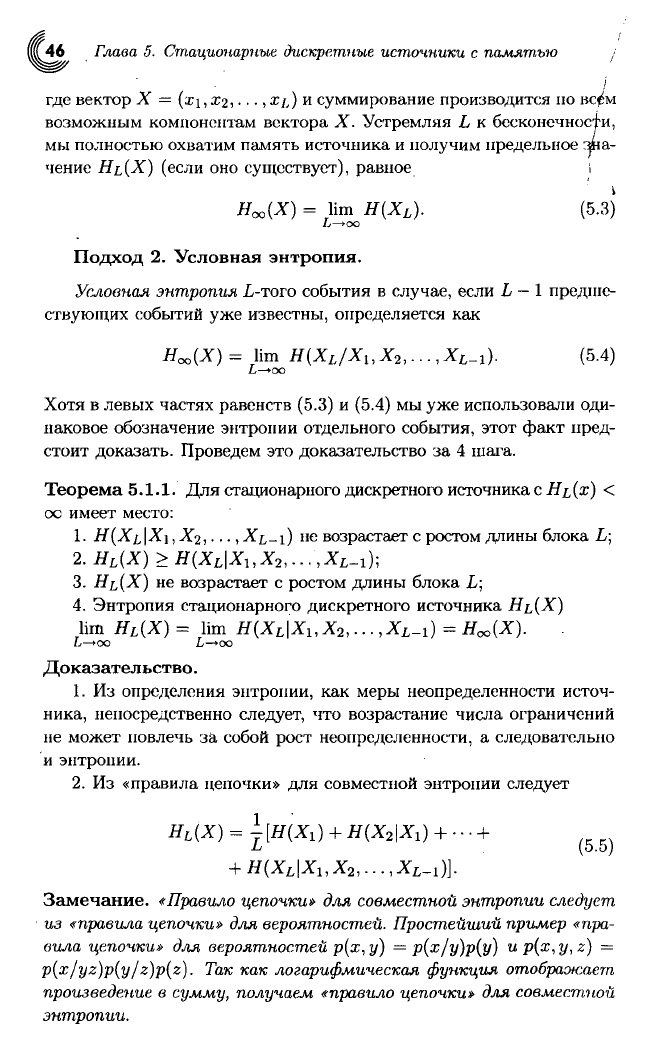

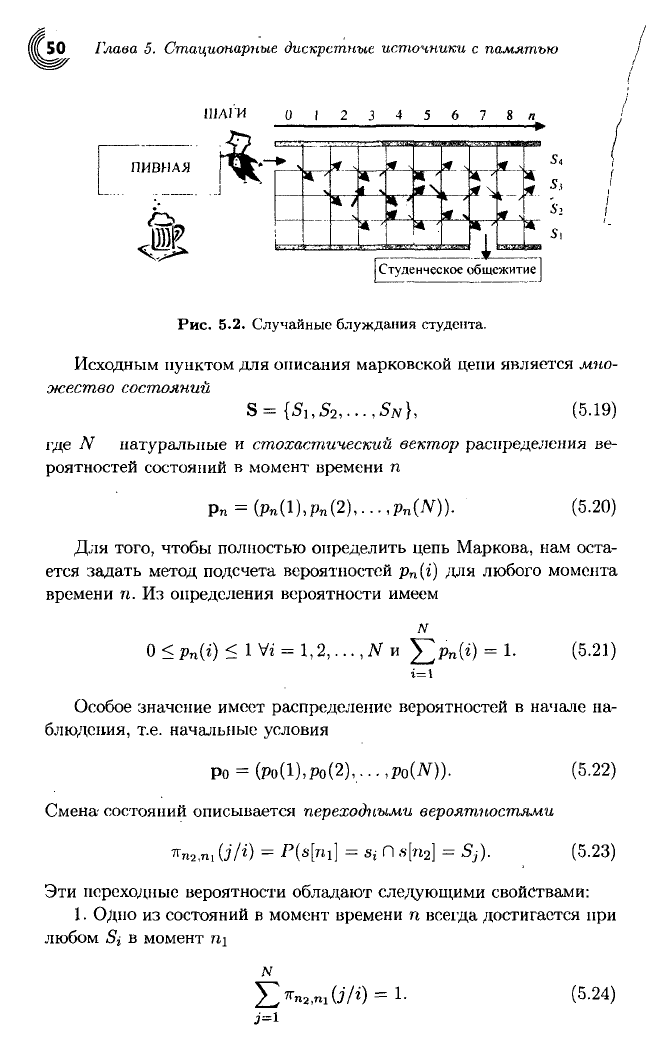

Пример:

Случайные блуждания студента.

Нас

интересует вопрос

о

том, доберется

ли

пьяный студент

от

дверей пивной

до

дверей студенческого общежития. Поставим

во-,

прос но

другому

(рис.

5.2):

какова вероятность того,

что

случайные

блуждания на

7

временном шаге приведут студента

в

пространствен-

ное состояние

Si?

или

Р («случайные блуждения» приведут

к

состоянию

Si в

момент

времени

п = 7).

Ситуация, изображенная

на

рис.

5.2 уже

содержит

в

себе

важ-

нейшие

признаки цени Маркова. Под марковской цепью понимается

дискретный

во

времени

и по

состоянию марковский процесс

S(n).

Его реализацией является множество путей, ведущих

из

состояний

5i

в

состояние

S;.

'А.

А.

Марков

(1856 1922) -

выдающийся русский математик. Прим.

перев.

50 Глава 5. Стационарные дискретные источники с памятью

ШАГИ

012345678л

ПИВНАЯ ГЧЖ*~~

I

TV

J

*****

*

)

Щ"

7

*

ч

*

-

*

'

Щ

-

#

м

ЯГ

7

If N,

1

3» ч

5

А.

5

«Li

s

^

.

Студенческое

общежитие

Рис.

5.2.

Случайные блуждания студента.

Исходным пунктом для описания марковской цепи является мно-

жество

состояний

(5.19)

где /V натуральные и

стохастический

вектор

распределения ве-

роятностей состояний в момент времени п

Рп = (Рп(1),Рп(2),...,Рп(Л

г

)).

(5.20)

Для того, чтобы полностью определить цепь Маркова, нам оста-

ется задать метод подсчета вероятностей р„(г) для любого момента

времени

п. Из определения вероятности имеем

(5.21)

г=1

Особое значение имеет распределение вероятностей в начале на-

блюдения, т.е. начальные условия

Ро

= (Ро(1),Ро(2),...,Ро(Л0).

(5-22)

Смена

состояний описывается

переходными

вероятностями

Тад,», 07*)

=

P(a[m]

= s

t

n s[n

2

] = Sj).

(5.23)

Эти

переходные вероятности обладают следующими свойствами:

1. Одно из состояний в момент времени п всегда достигается при

любом Si в момент п\

г) = 1-

(5.24)

5.3.

Конечные

цепи

Маркова

51

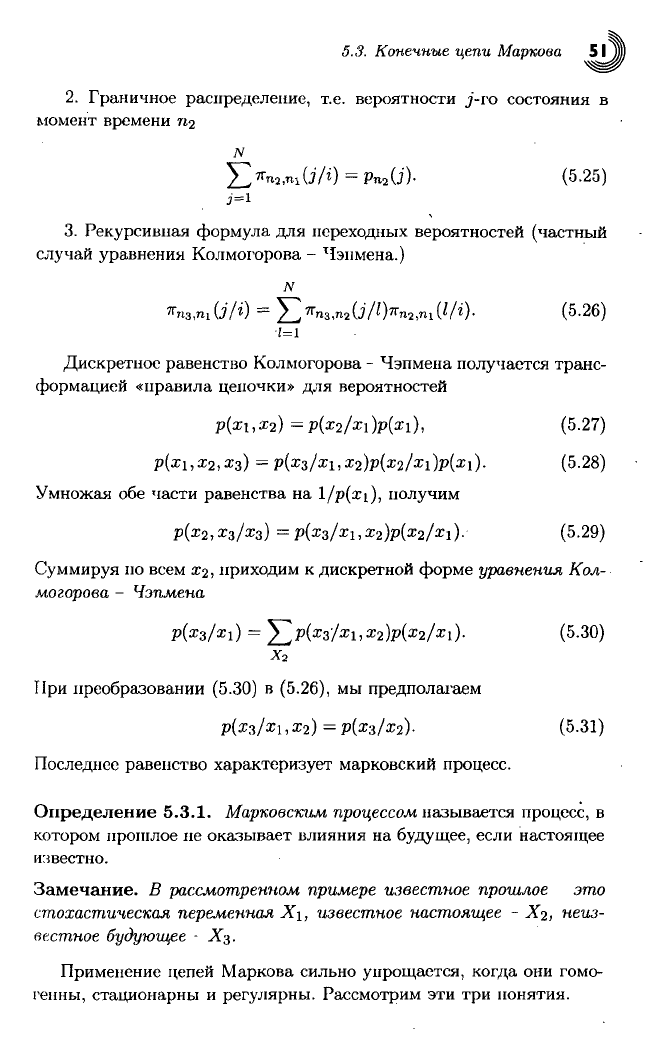

2. Граничное распределение,

т.е.

вероятности

j'-ro

состояния

в

момент времени

п

2

N

5Z

я'па.щО'Л)

=

Pmti)-

(5-25)

3. Рекурсивная формула для переходных вероятностей (частный

случай уравнения Колмогорова

-

Чэнмена.)

N

тпз.шО'А)

=

X!

7r

"3,n2070Tn

2

,ni(/A)- (5.26)

Дискретное равенство Колмогорова

-

Чэпмена получается транс-

формацией

«правила цепочки»

для

вероятностей

p{xi,x

2

)=p(x

2

/xi)p(xi),

(5.27)

р(х

ь

а;2,хз)

=

p(x3/xi,x

2

)p(x2/xi)p(xi).

(5.28)

Умножая

обе

части

равенства

на

\/р(х{),

получим

р{х

2

,х

3

/х

3

)

=р(хз/х1,х

2

)р(х

2

/х

1

).

(5.29)

Суммируя по всем

х

2

,

приходим

к

дискретной форме

уравнения

Кол-

могорова

-

Чэпмена

p(x

3

/xi) =

^2P(

X

3'/XI,X

2

)P(X

2

/XI).

(5.30)

х

2

При

преобразовании (5.30)

в

(5.26),

мы

предполагаем

р(хз/хьх

2

)

=р(х

3

/хг). (5.31)

Последнее равенство характеризует марковский процесс.

Определение

5.3.1. Марковским

процессом

называется процесс,

в

котором прошлое

не

оказывает влияния

на

будущее, если настоящее

известно.

Замечание.

В

рассмотренном

примере

известное

прошлое

это

стохастическая

переменная

Х\,

известное

настоящее

- Х

2

,

неиз-

вестное

будующее

- Х

3

.

Применение

цепей Маркова сильно упрощается, когда они гомо-

генны,

стационарны

и

регулярны. Рассмотрим эти

три

понятия.

Глава

5.

Стационарные

дискретные

источники

с

памятью

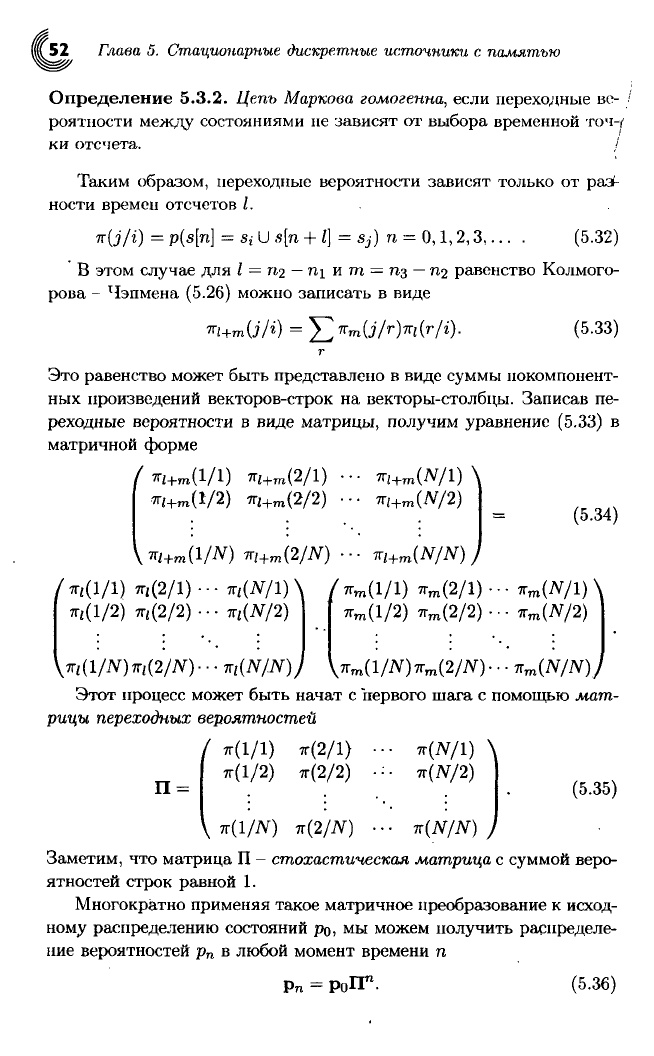

Определение

5.3.2. Цепь Маркова

гомогенна,

если переходные

ве- /

роятности между состояниями

не

зависят

от

выбора временной точ-е

ки

отсчета.

/

Таким

образом, переходные вероятности зависят только

от раз(-

ности

времен отсчетов

I.

Tr{j/i)

= p(s[n] = Si U a[n +

I]

= Sj) n =

0,1,2,3,...

.

(5.32)

В этом случае

для I = ri2 - n\ и т = пз

—

пг

равенство Колмого-

рова

-

Чэпмена (5.26) можно записать

в

виде

n+m{Jli)

=

(5.33)

Это равенство может быть представлено в виде суммы покомпонент-

ных произведений векторов-строк на векторы-столбцы. Записав пе-

реходные вероятности в виде матрицы, получим уравнение

(5.33)

в

матричной форме

тг

1+т

(1/1)

т

+т

{2/1)

• • •

TT

l+m

(N/l)

\

7г

(+т

(1/2) тг,

+т

(2/2)

•••

m

+m

(N/2)

(5.34)

\jr

J+ra

(l/JV)

n

+m

(2/N)

•••

7r

l+m

(N/N)J

7T,(2/1)

• • •

m(N/l)

\ I

7T

m

(l/l) 7T

m

(2/l)

JT,(2/2)

• • •

TrHiV/2) 7r

m

(l/2) 7r

m

(2/2)

ym(l/N)m(2/N)

• • •

*i{N/N)J \n

m

(l/N)7r

m

(2/N)

• • •

it

m

(N/N)J

ЭТОТ

процесс может быть начат с первого шага с помощью мат-

рицы

переходных

вероятностей

п

=

7T(2/1)

тг(1/2)

TT(2/2)

тг(ЛГ/2)

(5.35)

7r(l/iV)

тг(2/ЛГ)

••• 7r(iV/iV)

Заметим,

что

матрица

П -

стохастическая

матрица

с

суммой веро-

ятностей строк равной

1.

Многократно

применяя такое матричное преобразование

к

исход-

ному распределению состояний

ро, мы

можем получить распределе-

ние

вероятностей

р

п

в

любой момент времени

п

р

п

=

р

0

П". (5.36)