Рыков В.В., Иткин В.Ю. Математическая статистика и планирование эксперимента

Подождите немного. Документ загружается.

Глава 5 Планирование эксперимента 130

Упражнения

1. Исследуйте зависимость пористости от глинистости, взятых из

Таблицы 1 Приложения 2.

2. Оцените взаимозависимость пористости и проницаемости из

Таблицы 1 Приложения 2.

Задачи

1. Докажите лемму 18.1.

2. Докажите лемму 18.3.

3. Пусть (X, Y ) равномерно распределены в единичном квадрате.

Вычислите регрессию X по Y и Y по X.

4. Пусть (X, Y ) равномерно распределены в единичном квадрате.

Вычислите регрессию X

2

по Y

2

и Y

2

по X

2

.

5. Вычислите регрессию координат двумерного нормального рас-

пределения. Чему равны коэффициенты регрессии?

Глава 5 Планирование эксперимента 131

§ 19 Метод наименьших квадратов

19.1 Линейная регрессионная модель

В прикладных задачах часто приходится сталкиваться с линей-

ной регрессионной моделью при неслучайных регрессионных пере-

менных вида

Y =

~

β

0

X + (19.1)

где

~

β

0

= (β

0

, β

1

, . . . , β

k

)— вектор неизвестных параметров, x

0

=

(x

1

, . . . , x

k

)—вектор регрессионных переменных, —с лучайн ая ошиб-

ка наблюдения (обычно предполагается, что ∈ N(0, σ

2

)).

Примеры

1. Эмпирическая линейная зависимость. Пусть на основа-

нии априорных теоретических или эмпирических данных известно,

что имеет место зависимость вида (19.1), коэффициенты которой

неизвестны.

2. Эмпирическая нелинейная по x зависимость. Линейная

регрессионная модель допускает исследование и нелинейных (но не

по параметрам) зависимостей от регрессионных переменных x

0

=

(x

1

, . . . , x

k

) вида

Y = β

0

+

X

1≤j≤r

β

j

φ

j

(x

1

, . . . , x

k

) + . (19.2)

Достаточно сделать замену, полагая z

j

= φ

j

(x

1

, . . . , x

k

), чтобы свести

модель к предыдущей.

3. Линейная регрессия (оценка коэффициентов). Пусть из-

вестно, например, что с.в. x имее т многоме рное нор мальн ое распре -

деление. Тогда, как известно, все регрессии линейны, так что по на-

блюдениям необходимо оценить коэффициенты регрессии.

4. Подгонка регрессии линейной. Если нет оснований счи-

тать совместное распределение нор мальн ым, часто все-таки оказы-

вается, что регрессия близка к линейной. Возникает задача подгонки

истинной регрессии линейной и оценки соответствующих коэффици-

ентов.

Глава 5 Планирование эксперимента 132

19.2 МП оценка коэффициентов линейной регрессии

Рассмотрим сначала задачу оценки неизвестных коэффициентов

регрессии в линейной модели (19.1) при неслучайных регрессионных

переменных x = (x

1

, . . . x

k

) по выборке y = (y

1

, . . . , y

n

) объема n.

Вычислим ОМП коэффициентов регрессии в предположении, что

ошибки наблюдений

i

независимы и нормально распределены,

i

∈

N(0, σ

2

). Функц ия правдоподобия в этом случае имеет вид

L(

~

β, y) =

1

p

(2π)

n

det C

exp

−

1

2

(y − X

~

β)

0

C

−1

(y − X

~

β)

, (19.3)

где y = (y

1

, . . . , y

n

) — вектор наблюдений, X—м атриц а значений

регрессионных переменных, а C

—ковариационная матрица векто-

ра ошибок. Оценки b =

ˆ

~

β параметров

~

β = (β

0

, β

1

, . . . , β

k

) находятся

из системы нормальных уравнений

0 =

∂

∂β

j

ln L(

~

β, y) = −

1

2

∂

∂β

j

[(y − X

~

β)

0

C

−1

(y − X

~

β)] =

= −

1

2

∂

∂β

j

[−y

0

C

−1

X

~

β −

~

β

0

X

0

C

−1

y +

~

β

0

X

0

C

−1

X

~

β)] =

= −

1

2

[(y

0

C

−1

X)

0

− X

0

C

−1

y

0

+ X

0

C

−1

X

~

β + (

~

β

0

X

0

C

−1

X)

0

] =

= X

0

C

−1

y − X

0

C

−1

X

~

β (19.4)

В последнем равенстве использована симметричность матрицы C,

C

0

= C. Откуда

X

0

C

−1

X

~

β = X

0

C

−1

y.

Но так как C

= σ

2

I, т.е. C

−1

= σ

−2

I и, следовательно, X

0

X

~

β = X

0

y,

то пр едп олагая, что матрица X

0

X не вырожденная получим

b =

ˆ

~

β = (X

0

X)

−1

X

0

y. (19.5)

Пример 19.1. Рассмотрим простую линейную модель от одной ре-

грессионной переменной,

Y = β

0

+ β

1

x +

Глава 5 Планирование эксперимента 133

В э том случае

X =

1 x

1

1 x

2

.

.

.

.

.

.

1 x

n

, Y =

y

1

y

2

.

.

.

y

n

,

так что

X

0

X =

1 . . . 1

x

1

. . . x

n

×

1 x

1

.

.

.

.

.

.

1 x

n

=

n

P

1≤i≤n

x

i

P

1≤i≤n

x

i

P

1≤i≤n

x

2

i

,

и, с лед овательно,

(X

0

X)

−1

=

1

n

P

1≤i≤n

x

2

i

− (

P

1≤i≤n

x

i

)

2

P

1≤i≤n

x

2

i

−

P

1≤i≤n

x

i

−

P

1≤i≤n

x

i

n

=

=

n

n

2

x

2

− (¯x)

2

x

2

−¯x

−¯x 1

.

Далее

X

0

Y =

1 . . . 1

x

1

. . . x

n

×

y

1

.

.

.

y

n

=

P

1≤i≤n

y

i

P

1≤i≤n

x

i

y

i

= n

¯y

xy

и, с лед овательно,

b =

ˆ

~

β = (X

0

X)

−1

X

0

Y =

1

x

2

− (¯x)

2

x

2

−¯x

−¯x 1

×

¯y

xy

=

=

1

S

2

x

x

2

¯y − ¯xxy

−¯x¯y + xy

=

1

S

2

x

x

2

¯y − ¯x(xy − ¯x¯y + ¯x

¯

)

−¯x¯y + xy

=

1

S

2

x

S

2

x

¯y − ¯xk

xy

−k

xy

.

Здесь через k

xy

обозначена оценка коэффициента ковариации κ

xy

величин X и Y , а через S

2

x

эмпирическая дисперсия и использованы

Глава 5 Планирование эксперимента 134

соотношения

k

xy

=

1

n

X

1≤i≤n

(x

i

− ¯x)(y

i

− ¯y) =

1

n

X

1≤i≤n

x

i

y

i

− n¯x¯y −n¯x¯y + n¯x¯y

=

= xy − ¯x¯y

и

S

2

x

=

1

n

X

1≤i≤n

(x

i

− ¯x)

2

=

1

n

X

1≤i≤n

x

2

i

− 2n¯x¯x + n(¯x)

2

= x

2

− (¯x)

2

.

Таким образом, используя обозначение r

xy

для выборочного коэф-

фициента корреляции и соотношение

r

xy

=

k

xy

S

x

S

y

найдем

b

0

=

ˆ

β

0

= ¯y −

S

y

S

x

¯xr

xy

, b

1

=

ˆ

β

1

=

S

y

S

x

r

xy

, (19.6)

или

y = ¯y −

S

y

S

x

r

xy

¯x +

S

y

S

x

r

xy

x.

Последнее равенство удобно переписать и запомнить в симметричной

форме

y − ¯y

S

y

= r

xy

(x −

¯x

S

x

). (19.7)

19.3 Метод наименьших квадратов

Итак, в предположении, что регрессионные переменные x

j

не сл у-

чайны, а ошибки наблюдений

i

независимы и нормально распр е-

делены, было показано, что МП-оценки коэффициентов линейной

регрессии зависимости (19.1) получаются путем минимизации квад-

ратичной формы

(Y − X

~

β)

0

C

−1

(Y − X

~

β) (19.8)

Глава 5 Планирование эксперимента 135

по п ер еме нн ым β

j

и имеют вид (19.5)

Теперь можно отказаться от предположения о нормальности рас-

пределения ошибок и их независимости, сохранив, однако, требова-

ние их некоррелированности и равноточности, D

i

= σ

2

, а также

отсутствия систематической ошибки, M

i

= 0, и неслучайности ре-

грессионных переменных x

j

. (Напомним, что в случае нормальности

распределения ошибок их независимость и некоррелированность эк-

вивалентны).

В этих более общих предположениях будем и скать оценки коэф-

фициентов регрессии исходя из условия минимизации квадратичной

формы (19.8). Обоснованием такого подхода является, во-первых,

тот факт, что в нормальном случае соответствующие оценки совпа-

дают с МП-оценками, и, во-вторых, то, что соответствующие оценки

минимизируют “расстояние” между истинной регрессие й и ее оцен-

кой в “естественной” евклидовой метрике. Еще одним обоснованием

приемлемости такого подхода являются свойства оценок, рассматри-

ваемые в сл ед ующем разде ле.

Заметим, что в предположении о некоррелированности и рав-

ноточности ошибок наблюдений их матрица ковариаций имеет вид

C

= C = σ

2

I, откуда следует, что обратная матрица равна C

−1

=

σ

−2

I. Таким образом, минимизация квадратичной формы (19.8) эк-

вивалентна минимизации другой квадратичной формы

(Y − X

~

β)

0

(Y − X

~

β) (19.9)

Определение 19.1. Оценки

ˆ

~

β = b коэффициентов линейной

регрессии, полученные путем минимизации квадр атичн ой формы

(19.8), называются оценками наименьших квадратов (ОНК), а ме-

тод их получения — методом наименьших квадратов (МНК).

19.4 Свойства метода наименьших квадратов

Несмещенность

Mb = M(X

0

X)

−1

X

0

Y = M(X

0

X)

−1

X

0

(X

~

β + ~) =

~

β.

Глава 5 Планирование эксперимента 136

Точность

C

b

= M(b −

~

β)(b −

~

β)

0

=

= M([(X

0

X)

−1

X

0

Y −

~

β][((X

0

X)

−1

X

0

Y −

~

β]

0

=

= M([(X

0

X)

−1

X

0

(X

~

β + ~) −

~

β][((X

0

X)

−1

X

0

(X

~

β + ~) −

~

β]

0

=

= M[(X

0

X)

−1

X

0

~][((X

0

X)

−1

X

0

~]

0

=

= M[(X

0

X)

−1

X

0

~~

0

(X

0

X)

−10

] =

= (X

0

X)

−1

X

0

σ

2

IX(X

0

X)

−10

= σ

2

(X

0

X)

−10

= σ

2

(X

0

X)

−1

.

Таким образом, ошибка оценки зависит от выбора матрицы наблю-

дений X, что используется в дальнейшем при планировании экспе-

риментов.

Свойство оптимальности НК-оценок

Как следует из (19.5) ОНК являются линейными относительно

наблюдений y оценками. При этом они обладают важным свойством

оптимальности. Именно, справедлива

Теорема 19.1 (Маркова). Среди всех линейных относительно на-

блюдений y несмещенных оценок коэффициентов линейной регрес-

сии ОНК обладают минимальной дисперсией. Другими словами,

пусть t = T y—несмещенная оценка Mt =

~

β, где T —некоторая

матрица. Тогда диагональные элементы матрицы C

t

минимальны

тогда и только тогда, когда

T = (X

0

X)

−1

X

0

. (19.10)

Доказательство. Из несмещенности вытекает, что

Mt = MT (X

~

β + ~) = MT X

~

β + MT~ = MT X

~

β =

~

β,

Глава 5 Планирование эксперимента 137

т.е. T X = I. Далее

C

t

= M(t −

~

β)(t −

~

β)

0

= M[T (X

~

β + ~) −

~

β][T (X

~

β + ~) −

~

β]

0

=

= M[T X

~

β + T~ −

~

β][T X

~

β + T~) −

~

β]

0

=

= M[T X

~

β −

~

β][T X

~

β −

~

β]

0

+ M[(T X

~

β −

~

β)~

0

T

0

] +

+ M[T (T X

~

β −

~

β)

0

] + M[(T~~

0

T

0

] = σ

2

T T

0

.

Теперь с учетом того, что T X = I из тождества

T T

0

= [T −(X

0

X)

−1

X

0

][T −(X

0

X)

−1

X

0

]

0

+ [(X

0

X)

−1

X

0

][(X

0

X)

−1

X

0

]

0

вытекает, что диагональные элементы матрицы T T

0

принимают ми-

нимальные значения равные (XX

0

)

−1

при T = (X

0

X)

−1

X

0

.

Следствие. ОНК некоторой линейной функции от параметров,

скажем ~α = A

~

β, обладают теми же свойствами оптимальности

и имеют вид

a =

ˆ

~α = A(X

0

X)

−1

X

0

y. (19.11)

19.5 Дополнения

Вопросы для контроля

1. Дать опреде лен ия:

а) линейной регрессионной модели,

б) оценок наименьших квадратов,

в) метода наименьших квадратов,

г) привести формулы для оценки коэффициентов регрессии в

двумерной нормальной регрессионной модели.

Упражнения

1. Вывести уравнение (4) с использованием функции правдоподо-

бия в координатной записи.

Глава 5 Планирование эксперимента 138

2. Построить регрессионную модель концентрации светлых нефте-

продуктов, выкипающих при 350 градусах в зависимости от плотно-

сти нефти. Использовать данные из приведенной таблицы 1, в кото-

рой x- значения плотности нефти а y - эмпирическая концентрации

светлых нефтепродуктов.

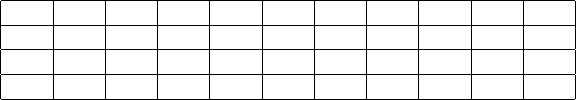

Таблица 1.

x 910 836 869 865 866 841 844 862 807 865

y 54 58, 6 47, 7 47, 5 45, 3 58, 3 59 49,6 66,6 51,3

x 791 829 857 866 868 840 864 838 880 868

y 72,2 55,3 48,9 48,7 46,1 57,8 48,6 59,6 44 44,7

3. Сформулировать и доказать теорему Маркова.

4. Объяснить, почему м ин ими заци я квадратичной формы (9) дает

оценку коэффициентов β.

5. Построить регрессионную зависимость цены квартиры от сле-

дующих факторов:

а) время п ешком до метро в минутах;

б) этажность здания;

в) этаж, на котором находится квартира;

г) общая пл ощадь в квадратных метрах;

д) жилая площадь в квад ратных метрах;

е) площадь кухни в к вадратных метрах.

Использовать данные из таблицы 2, в которой x

1

-время пешком до

метро, x

2

-этажность здания, x

3

-этаж, на котором находится квар-

тира, x

4

-общая площадь, x

5

-жилая площадь, x

6

-площадь кухни, y-

цена квартиры в тысячах долларов США.

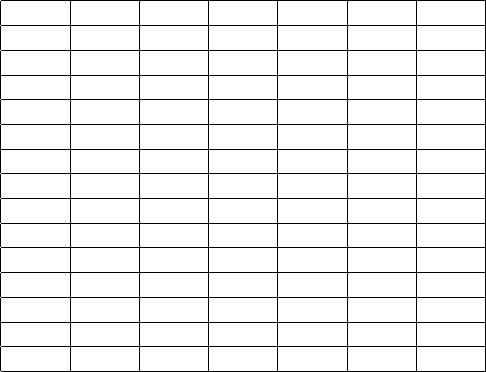

Таблица 2.

Глава 5 Планирование эксперимента 139

x

1

x

2

x

3

x

4

x

5

x

6

y

15 9 7 38 22 8 105

2 9 3 36 25 6 110

20 9 8 44 28 6 115

10 12 3 52 31 10 115

12 12 6 48 30 9,2 128

10 9 7 42 25 7 130

10 15 7 55 31 8,5 135

15 9 7 48 30 7 140

10 9 3 38 24 7,8 140

7 9 3 43 27 6 140

1 9 6 36 22 5,5 150

10 8 2 55 34 8 150

10 12 10 40 24 7,5 150

15 17 7 51 30 8,5 150

Лабораторная работа

По индивидуальным данным, предложенным преподавателем из

Приложения В, вычислить коэффициенты линейной регрессии и по-

строить линии регрессии совметно с полем наблюдений.